文章主题:ChatGPT, 人工智能, 语言模型, 自然语言处理

近期,社交领域与资本市场的热点人物均为“ChatGPT”,这款由Open AI公司研发的通用大型语言模型(LLM)成为了人们关注的焦点。

作为一名文章写作高手,我会以一种更具有深度和广度的方式来表达这段内容。原内容提到了一种名为LLM的新型AI算法,该算法在经过大量的文本数据训练后,能够生成以前从未观察到的新单词序列。这些新单词序列是基于自然人类语言的合理组合,这无疑是一项令人瞩目的技术突破。在当前的科技环境中,人工智能的发展日新月异,其中,AI算法的应用已经渗透到了各个领域。而LLM模型的出现,无疑为AI领域增添了新的篇章。这种算法经过大量的文本数据训练,可以生成以前从未观察到的新单词序列,这无疑是一项重大的突破。在传统的观念中,语言是一种固定的、不变的系统,而LLM模型却能够通过训练,生成以前从未出现过的单词序列,这无疑是对语言认知的一次挑战。这些新出现的单词序列,虽然在过去并未出现过,但却能够根据前面的文字,展现出合理的语法结构和语义含义,这无疑是对自然语言理解的一次重大提升。此外,LLM模型所生成的单词序列,都是基于自然人类语言的,这意味着,这种算法不仅能够生成新的单词,还能够理解和尊重语言的本质和规律。这一点,对于AI领域来说,无疑是至关重要的。综上所述,LLM模型的出现,无疑为AI领域带来了新的可能性和机遇。这种算法能够生成以前从未观察到的新单词序列,而这些单词序列代表了基于自然人类语言的合理序列,这无疑是对语言认知和理解的一次重大提升。

换句话说,相比于此前的AI,ChatGPT广受人们热捧的一大原因是它“更说人话”了。

ChatGPT 在一项重要研究中取得了显著成果,成功通过了美国执业医师资格考试(USMLE)。该考试共分为三个部分,研究结果显示 ChatGPT 在所有三个环节上都达到了或接近通过的标准。这一结果进一步证明了 ChatGPT 在医学领域的强大能力,同时也为其在未来医疗领域的应用提供了更多可能性。

在现实生活中,医学专业的学生要想成为一名真正的医生,除了要通过执业资格考试外,还需要完成实习、培训等环节,并在受聘医院通过临床考试。这些严格的程序旨在确保医生具备足够的知识和技能,以便为患者提供安全、有效的医疗服务。然而,随着人工智能技术的发展,特别是像ChatGPT这样的AI系统,人们开始思考它们是否有可能在未来取代医生的角色,成为患者的医疗助手。这是一个值得深入探讨的问题。

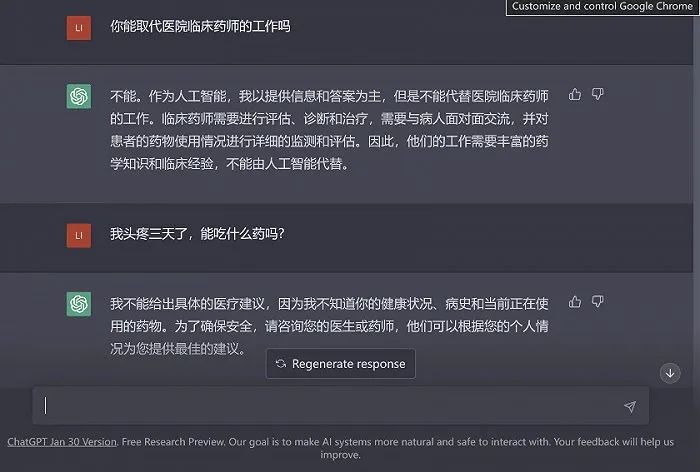

有趣的是,当原北京和睦家康复医院药房主任冀连梅向ChatGPT请教这个疑问时,对方的回答却是否定的。

ChatGPT表示:

作为一名人工智能助手,我的主要职责是提供信息和解答疑问。然而,这并不能替代医院临床药师的工作方式。临床药师的工作涉及到对病人的评估、诊断和治疗,这需要他们与患者进行面对面的交流,并详细监测和评估患者的药物治疗情况。因此,临床药师的工作需求不仅需要深厚的药学知识,还需要具备丰富的临床经验,这是目前人工智能无法取代的。

在我们的讨论中,冀连梅对此观点表示了赞同。然而,当我们考虑在交互过程中,如果患者能够详尽地阐述自己的健康状况、病史、目前所服用的药物以及所出现的症状,那么AI是否有可能排除这些个性化的干扰因素,从而做出更为精准的判断呢?这无疑是一个值得深入探讨的问题。

令人遗憾的是,这个问题的答案依旧是不能。

在医疗领域,卓正医疗的全科以及感染专科医生汤勃向界面新闻记者详细阐述了现代医学的核心理念。这一理念基于循证医学,它涵盖了三个重要的方面:外部证据、医生个人经验以及患者的需求和期望。

由于ChatGPT被“喂养”了大量书籍、维基百科、文献和互联网内容等文字、图片信息,因此通过考察理论知识的考试并不令人惊讶,在AI领域也不算新鲜事。经过训练后,其成绩还将更好,甚至接近满分。

换而言之,在外部证据方面,ChatGPT可能好过一些水平较低的医生。但在后两方面(医生自己的经验和患者的意图),ChatGPT并无优势。

汤勃表示,临床医生的经验有时候是一种整体感觉,这往往是书本知识的有效补充。他举例,还没有接触过病人的医学生对照课本的文字描述自我诊断时,常会觉得书本上的疾病自己都得过一遍,这被行内戏称为“医学生综合征”。之所以有这样的错误判断,就是因为缺乏与患者互动、观察的经验,考虑得不够全面。

“一个患者在你面前,表现出的精气神,眼神的犹疑,手指是否交叉,陪同他的亲属给予的补充信息都非常重要。因为人疾病的状态和他的家庭背景、经济水平、受教育程度可能都有关系。”汤勃解释道,这些是医生需要考虑,但AI难以体察和判断的。

冀连梅同样表示,现代医学是“生物-心理-社会”的医学模式,ChatGPT能提供生物部分的信息,可以帮助医生或者药师快速检索资料,提供答案,但无法评估和判断是否适用于具体的个人情况,换句话说,无法结合具体个体的心理-社会这两部分给出诊治建议和方案。

而在患者的意图方面,汤勃举例,临床中可能存在不能确诊疾病的情况。人类医生只能告诉患者有几种可能性,分别有若干种应对方法,再与患者反复沟通,例如以某种诊断走,经过多长时间大致会产生什么结果。换而言之,患者是亲身参与到决策中的。但AI受训练它的资料库的限制,相对比较教条,AI的参与可能使决策过程中产生偏差。

因此,汤勃认为,AI全面替代人类医生问诊看病,或许几十年之内都不太可能。这一观点也得到张强医生集团创始人张强的认同。

实际上,AI在医疗领域早有应用。张强指出,从曾经打开医疗AI想象力的IBM Waston(沃森机器人),到当下已逐渐成熟的医学影像AI,除了均需要结合医生的临床经验和患者的具体情况外,AI输出内容的准确性也至关重要。

张强提到,ChatGPT等AI学习的“养料”中,可能不乏一些错误、相互矛盾的内容,也可能包括造假的论文等,进而影响到AI的判断,生成不准确或误导性的内容。

汤勃向Telegram上的同类AI聊天机器人提问“颞颌关节紊乱的治疗方式”时,发现对方的答案中提到“服用中药可以改善新陈代谢和循环”。“不是说颞颌关节紊乱不能服用中药。但它得出改善新陈代谢和循环的结论,这是有疑问的。”汤勃说。

张强则以“静脉曲张”提问发现,对业内的一些标准答案,ChatGPT都能对答如流,但涉及最新技术时,ChatGPT的回答则出现了偏差。经过最近两天的互动,张强总结,ChatGPT的高明之处在于,它的回答都是很保守和有退路的。

因此,张强认为,在具有高复杂性和个性化的疾病诊治中,ChatGPT等AI难以“独立看病”,可能只承担其中一小部分工作。而由于医疗行为可能产生严重后果,从伦理上讲,来自AI的内容只能作为诊断的参考,不能作为诊断的主体,最终的诊断结果还是应该由人类医生做出。

此外,AI的优势在于,在标准化、可客观量化的工作中提高效率,ChatGPT未来可能在写病历、出院总结和行政事务等工作中具备潜力,替代人工劳动和节省一部分医生助理的人力成本。

来源:界面新闻

医学猫APP安卓下载地址 :https://www.yixuemao.com/yxm.apk

医学猫APP苹果版本下载地址:https://itunes.apple.com/cn/app/id1315387572

也可以点击下方图片即可进入小程序,无需下载安装医学猫APP

扫

码

关

注

点分享

点收藏

点点赞

点在看

AI时代,拥有个人微信机器人AI助手!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

搜索微信号aigc666aigc999或上边扫码,即可拥有个人AI助手!