AI陪伴机器人火了!上市公司密集布局

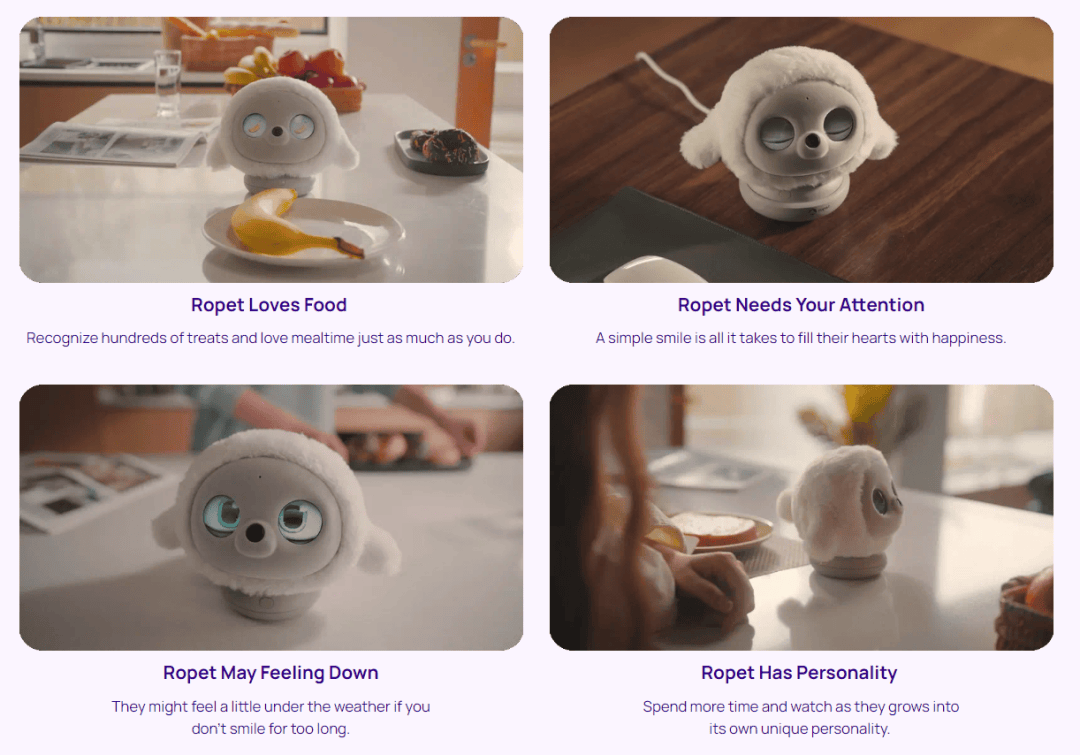

只能在手机上和AI对话?机器人必须有坚硬的外壳?本届CES(国际消费类电子产品展览会)上,新一代AI陪伴机器人集体亮相,宣告这些局限性正在成为过去式。 智能机器人也可以有可爱柔软的外形,可以感知情绪,可以用中英双语谈天说地,甚至可能成为人类用户的亲密伙伴、家庭的一份子。国内AI玩具、AI陪伴机器人赛道的热度也高居不下,A股上市公司实丰文化、汤姆猫等密集入局,产品陆续上市。市场研究认为,陪伴机器人覆盖儿童、青年、老年人等广泛的用户群体,中国陪伴机器人潜在市场需求近万亿元。 AI陪伴机器人集体亮相CES 来自创业公司萌宠智能的Ropet,有着温暖、柔软、毛茸茸的皮毛,可以对用户的触摸、声音甚至动作做出反应;它能够自我探索、互动,并在日常任务中为用户提供帮助。Ropet由多个传感器和前沿技术打造而成,旨在为年轻一代创造可爱的人工智能机器宠物。Ropet的名字就是Robot(机器人)Pet(宠物)的结合。 萌宠智能核心团队成员来自斯坦福大学、北京服装学院以及字节跳动、百度、阿里巴巴、小米和蔚来等公司。在这次CES亮相之前,Ropet已于2024年12月份登陆了北美众筹平台Kickstarter,获得了海外用户热烈的反响,已经拥有了10000多个潜在用户。 总部位于东京的初创公司Yukai Engineering在本届CES上推出了吉祥物机器人Mirumi。Mirumi通常被挂在手提包的带子上,旨在重现人们与人类婴儿相遇和互动的乐趣。它内置传感器,可以探测到周围的环境并“四处张望”;它以多种不同的方式移动头部,以表达它的好奇、害羞和其他类似婴儿的品质和情感。 “无论你是乘坐拥挤的火车还是在收银台排队,你的Mirumi总能想办法用它无辜的目光进入人们的心,促使人们向机器人挥手或做出有趣的表情作为回应。” TCL在CES现场展示了全球首款分体式AI陪伴机器人TCL Ai Me,这款产品不仅能实现与人的多模态自然交互,还能提供情感陪伴、智能控制家电等功能。三星展示了一款紧凑、球形的智能机器人Ballie,同样适用于在家居环境中提供智能语音和情感交互、智能家居控制等功能。 此外,日本AI机器人公司Jizai发布家居型AI机器人Mi-Mo,定位为全球第一款“可定制的通用人工智能机器人”。美国医疗机器人公司TOMBOT的AI仿真拉布拉多幼犬玩具狗JENNIE也在展会上亮相。 A股上市公司密集入局 1月9日上午,婴童概念股震荡走强,实丰文化涨停。在1月8日的投资者关系活动纪要中,实丰文化表示公司新一代AI玩具——AI魔法星已经正式开启预售。AI魔法星基于AIGC技术,运用豆包先进的大模型底层,进行二次训练出符合儿童对话习惯且脱离敏感话题的后台模式。 实丰文化还表示,公司可以将AI玩具的商业模式为IP服务。公司已取得国际IP宝可梦、游戏IP蛋仔派对、手游IP贪吃蛇大作战、动画IP超级飞侠等热门IP的正版授权。 实丰文化认为,看好AI玩具的两大功能,一是“AI+陪伴”功能,提供情绪价值和正能量;二是“AI+教育”功能,解决教育焦虑。AI玩具在老年人市场也有较大的空间。玩具是能快速落地的载体,将大模型装进玩具里,赋予了传统玩具生命力,可以提升人们生活的效率,提供情绪价值,市场空间也非常广阔。凭借生成式AI技术,可以实现实丰文化智能玩具品类的全面智能化升级。因此,公司对AI玩具的未来充满期待,后续公司也将持续加大在该领域的研发投入。 2024年12月30日,奋达科技在互动平台表示,与客户合作的陪伴类AI桌面机器人首批已出货,后续将根据客户订单安排生产制造。 汤姆猫AI童伴于2024年12月21日发售上市,其抖音官方带货直播间——会说话的汤姆猫家族凭借高涨的人气进入了抖音玩具模型榜榜一。 中国陪伴机器人潜在市场需求近万亿元 从上述公司的布局来看,AI陪伴机器人的目标群体涵盖了儿童、年轻人、老年人、情绪疾病患者等广泛群体。通过AI和先进传感器等技术的加持,新一代陪伴机器人的对话、互动、感知、行为能力增强,有望真正成为用户家庭中的一员。 AI陪伴机器人相较AI玩具具有更高的功能性和附加价值。据腾讯研究院调研,98%的受访者都考虑使用AI陪伴去弥补平日未被满足的社交需求。 国泰君安研究认为,中国陪伴机器人潜在市场需求近万亿元。参考宠物市场、潮玩市场、智能监测手表行业的发展趋势及渗透率情况,测算出陪伴机器人在老年人群中的潜在需求约4200亿元人民币,陪伴机器人在青年人群中的潜在需求约5000亿元人民币。在医疗场景下,尤其是自闭症儿童的情绪监控领域也有较大的应用前景。表情陪伴机器人是AI陪伴的高端品类,根据仿生学原理模仿人的外观设计、与人类进行自然交互,在强人机交互需求、强人形结构需求、强角色认同需求等场景具备独特优势。 国泰君安研报表示,表情陪伴机器人的核心技术壁垒包括情感智能与交互、面部表情控制与仿生皮肤设计。感知方面,表情陪伴机器人需要高精度的传感器来模拟生物的感知能力,如视觉、听觉、触觉、仿生皮肤等。情感计算的核心在于利用机器学习和人工智能算法,通过处理感知层捕捉到的人类的语音、面部表情、生理特征等多个维度情感信息,进行建模、计算、学习,从而实现与人类的交互,达成情感陪伴的需求。表情控制方面,语音、视觉、情感交互需要通过高度仿真的面部表情和触感实现,采用高精度的执行器控制机器人的表情输出。 作者:刘怡鹤返回搜狐,查看更多 责任编辑: