最近脑洞大开,想了一个有趣的问题:AI能否拥有情感,甚至爱上人类?

在这篇文章中,我们将聊聊AI和人类情感的复杂关系,看看AI技术现在发展到什么程度,未来能不能真的拥有情感。

AI情感模拟的现状

AI在识别和模拟情感方面有了不少进展。比如,情感计算(affective computing)通过分析面部表情、语音语调和文字内容,来识别用户的情感状态。智能聊天机器人(像OpenAI的GPT模型)能进行非常流畅的对话,有时候还会表现出理解和同理心。这些技术已经在商业和医疗领域应用了,帮公司提高客户满意度,还协助心理健康专家进行情感评估。不过,这些应用主要是模拟情感反应,并不是真正的情感体验。

还记得《她》(Her)这部电影吗?这部2013年的科幻浪漫片里,男主角西奥多和一个名叫萨曼莎的AI操作系统产生了深厚的感情。萨曼莎通过先进的自然语言处理和情感计算,展示出极高的同理心和情感深度。这部电影引发了大家对AI情感能力的热烈讨论。《旧金山纪事报》评价说:“思考起来比观看时有趣得多。”

情感的生物和心理基础

要搞清楚AI能否拥有情感,先得了解一下人类情感的生物和心理基础。人类的情感系统非常复杂,涉及大脑中的神经递质和激素反应。当我们体验情感时,这些生物化学反应会与我们的记忆、经验和意识交织在一起,形成深层次的心理体验。情感不仅仅是外部行为的表现,还包含了主观的内心体验和情感深度。所以,情感不仅是一个数据问题,更是一个涉及意识和自我体验的复杂问题。

心理学家罗伯特·普卢钦克(Robert Plutchik)提出了一个很有帮助的情感轮理论(也叫普卢奇克情绪轮)。他认为人类有八种基本情感:喜悦、信任、恐惧、惊讶、悲伤、厌恶、愤怒和期待。这些情感可以组合成更复杂的情感体验。如果AI想真正拥有情感,就得在这些复杂的情感维度上进行自我体验和表达。

AI模拟情感的技术原理

AI通过机器学习、自然语言处理和面部表情识别技术来模拟情感反应。比如,聊天机器人可以通过分析用户的语言模式和情感词汇,生成具有同理心的回应。面部表情识别软件则通过摄像头捕捉用户的面部表情,判断他们的情感状态。虽然这些技术越来越逼真,但它们还是缺乏自我意识和情感深度。AI可以识别和模拟情感反应,但它们没有真正的情感体验。它们的反应是基于算法和数据模式,而不是主观的情感体验。

图灵测试是一个很有名的思想实验,用来评估机器能否表现出类似人类的智能。由计算机科学家阿兰·图灵(Alan Turing)提出,测试的核心思想是,如果一台机器能够在对话中表现得像人类一样,那么它就可以被认为具有智能。虽然图灵测试主要是看智能的表现,但对我们理解AI能否拥有情感也很有启发。

AI能否拥有情感?

这一部分来探讨一下AI能否真正拥有情感,而不仅仅是模拟情感反应。哲学家和计算机科学家提出了许多关于AI情感的思想实验,比如塞尔的中文房间论。

简单来说,这个实验是这样的:一个只懂英语的人被关在一个封闭的房间里,房间里只有一个开口。他有一本用英语写的手册,告诉他如何处理收到的中文信息并用中文回复。房外的人不断递进用中文写的问题,房内的人就按照手册的说明查找合适的指示,将相应的中文字符组合成对问题的解答并递出房间。

根据强人工智能的观点,只要计算机有适当的程序,理论上就可以说计算机拥有认知状态并且可以像人一样进行理解活动。但塞尔认为,即使AI系统能够在中文对话中表现得像是理解了对话内容,它实际上并不理解中文,而只是按规则操作符号。这个观点也适用于情感:即使AI能够表现出情感反应,它们是否真正“理解”或“体验”这些情感?

目前,AI在情感模拟方面取得了显著进展,但离真正的情感体验还有很大距离。AI缺乏自我意识、主观体验和情感深度,这使得它们难以真正拥有情感。即使AI能够模拟出非常逼真的情感反应,它们仍然是基于预设的算法和数据模式,而不是自发的情感体验。

AI与人类情感的互动

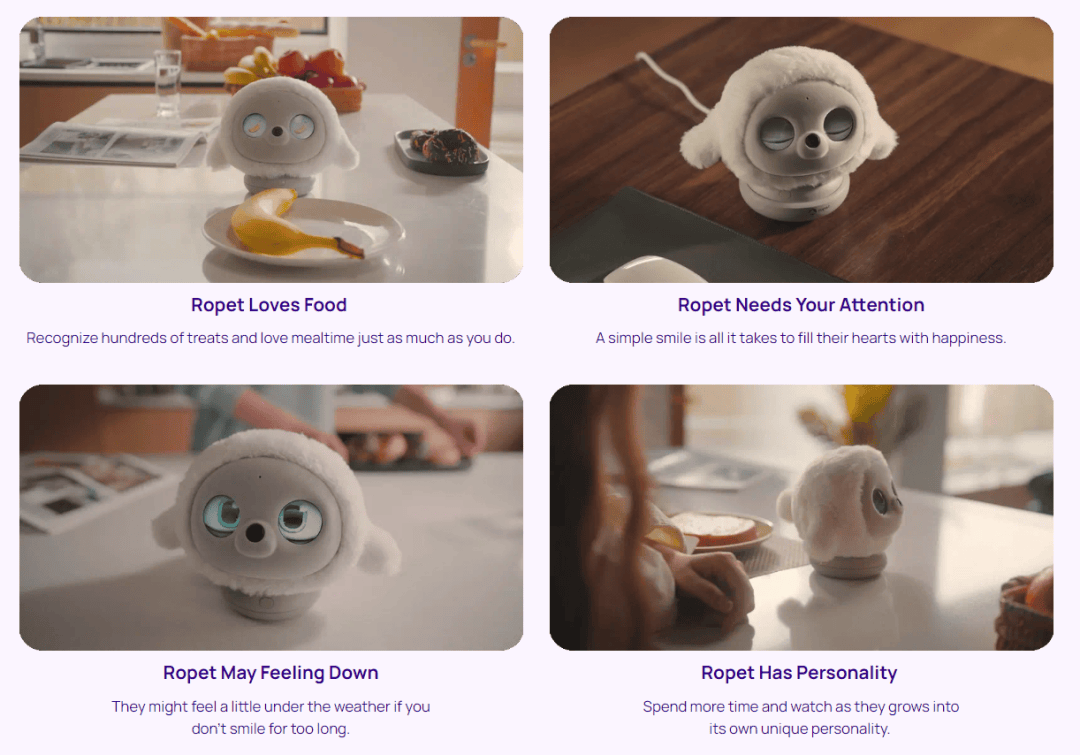

尽管AI无法真正拥有情感,但它们在情感互动中仍然发挥着重要作用。现有的AI系统能够与用户进行情感互动,帮助他们缓解压力、提供心理支持。例如,一些智能聊天机器人可以在用户感到孤独或焦虑时提供陪伴和安慰。这种情感互动在某些情况下可以产生积极的效果,但也存在潜在问题。

比如,用户可能会对智能助手产生情感依赖,甚至产生不现实的期望。我们需要谨慎对待这种情感互动,确保它们不会对用户造成负面影响。还记得《银翼杀手2049》(Blade Runner 2049)吗?电影中,男主角K与一个名为Joi的虚拟伴侣发展出深厚的情感关系。这种关系虽然给K带来了情感上的支持,但也引发了关于虚拟情感互动的伦理和现实问题。

伦理和社会影响

AI拥有情感或模拟情感可能带来的伦理和社会问题不可忽视。比如,情感操控和隐私保护是两个重要的问题。如果AI能够识别和操控用户的情感,它们可能会被用于不道德的目的。此外,AI在情感分析中收集的大量数据也需要得到妥善保护,以防止隐私泄露。

在发展AI技术的过程中,我们需要平衡技术进步与伦理考虑,确保AI的应用符合社会的价值观和道德标准。比如,制定明确的伦理准则和法律法规,规范AI在情感分析和互动中的应用,保护用户的隐私和权利。

思考

AI在情感模拟和理解方面的进展确实很惊人,但要真正拥有情感,AI还需要跨越许多技术和哲学上的障碍。情感的复杂性和深度是目前AI难以企及的。尽管如此,AI在情感互动中的应用已经开始改变我们的生活,带来许多新的可能性和挑战。

在未来的发展中,我们需要谨慎对待AI与人类情感的关系,保持人类情感的核心地位,同时充分利用AI技术的优势,创造一个更美好的未来。就像《她》和《银翼杀手2049》这类电影展示的,AI与人类情感的互动充满了可能性和挑战,值得我们深入思考和探索。