文章主题:情感验证, 职业倦怠缓解, 网络心理支持, 机械共情不足

ChatGPT 轰炸了互联网。

🎉🚀【AI巨擘引领】揭秘Open AI旗下热销🔥超速成长的聊天机器人,短短两个月就突破亿级用户大关,创下了历史性的速度记录!💡它以卓越的人工智能技术,颠覆传统沟通方式,为全球消费者带来前所未有的便捷体验。🌍只需轻轻一点,就能与这智慧的伙伴畅所欲言,让每一天都充满惊喜与乐趣!✨赶紧加入这场数字化革命,感受未来已来的力量吧!👉更多详情,敬请关注我们的最新动态更新。👋

ChatGPT 能做很多事。

🌟👩💻提供全方位创意服务!🚀无论是代码编写👨💻,还是独特约会攻略💡,或是以莎翁笔法探索未来科幻世界📚,我都能为你量身打造精彩内容。别再让创意闲置,十个请假理由轻而易举,让你的日常轻松又不失幽默。👩💼情感交流?这里也是你的避风港🌈。倾诉、倾听,让我们共同守护你的情绪绿洲。隐私至上,只留下智慧与温暖。💌想要提升品牌形象?我用专业文字点亮你的世界💡。让每一次沟通都触动心灵,让SEO优化的文案带你飞升搜索引擎之巅🌍。立即行动,释放你的无限可能!别忘了,创意无界,我在此等你共享创新之旅🚀。

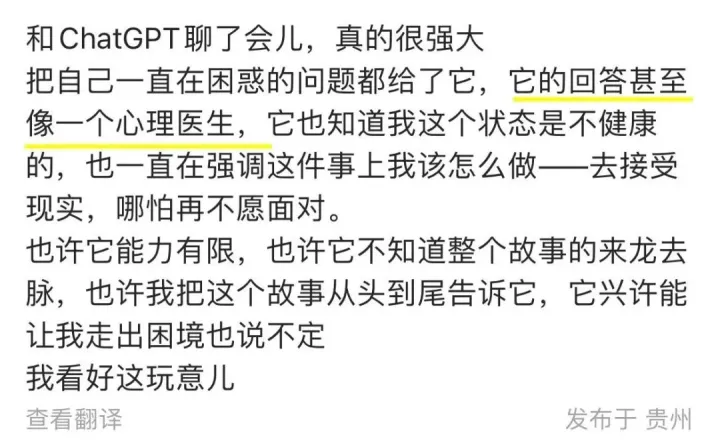

翻到一些微博评论说:

「真的很强大……它的回答甚至像一个心理医生」。

清华积极心理学学者赵昱鲲(半开玩笑):心理工作者,要看看别的机会啦!

真有这么好用吗?

🌟作为一名资深的心理咨询专家,我对ChatGPT的崛起难免有些关注。🤔尽管它在交流和信息处理方面展现出了强大的能力,但我坚信,心理编辑的工作远非单一的复制粘贴那么简单。💼ChatGPT确实能提供一些基础的心理建议,但它缺乏人性化的理解和深度分析。心理咨询不仅仅是技术的应用,更是情感与复杂人类行为的专业解读。👩⚕️至于取代程度,我认为它更像是一个有力的补充工具,而非完全颠覆。它可以协助初筛和简单的咨询,但复杂的心理问题和深层次的治疗需求,还需要面对面的专业指导。🤝让我们期待科技如何改变行业,同时也坚守我们的专业边界,为客户提供最优质的心理服务。👩🎓记得,每个角色都有其独特的价值,心理咨询师的角色不会因为ChatGPT的存在而黯淡。🌈

于是,最近一周我频繁使用 ChatGPT (摸鱼)。

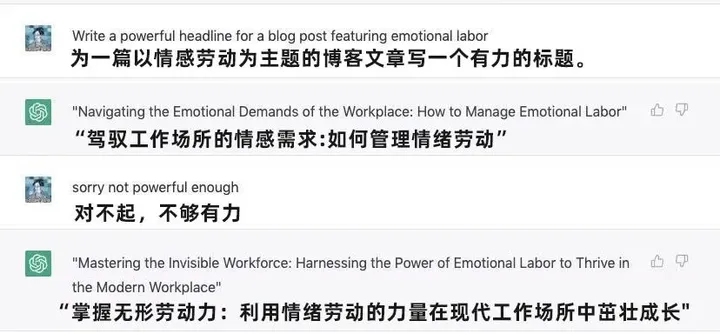

比如,让它给文章起个标题:

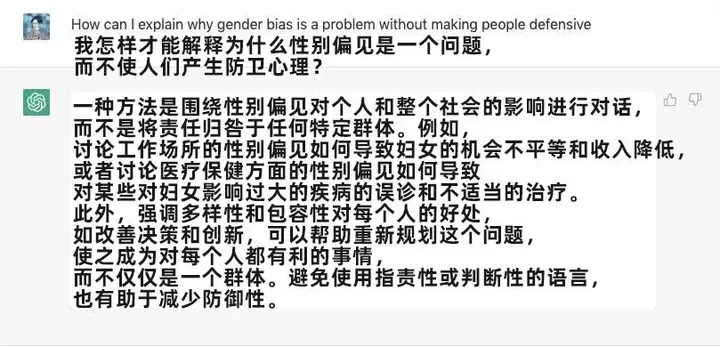

真心寻求建议:我要如何科普「性别偏见」才能不让一些人跳脚?

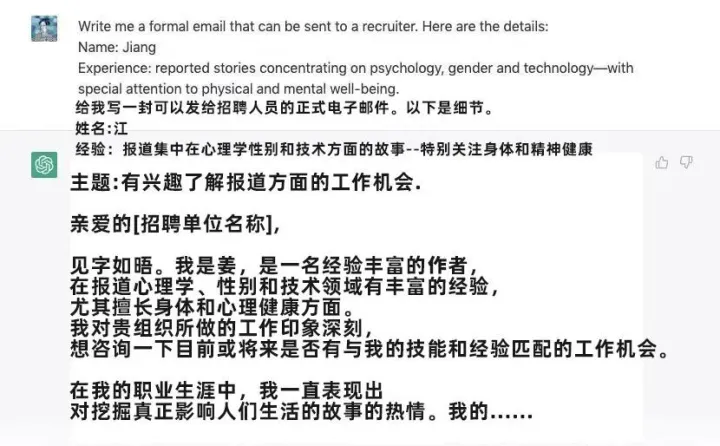

不想干了。罗列几个关键词,帮我写一封求职邮件:

向它抱怨一下:我感到生活很没意义。

哦,好厉害!

我觉得自己被共情了!(流泪猫猫头)

提前泼一盆冷水:

🎉💡 作为一名文章撰写者,我深知人们常常沉溺于人工智能带来的短暂慰藉中,误以为自己被深度理解和接纳。然而,AI领域的权威人士 Lance B. Eliot 提醒我们,这并非必然。往往,当我们过于依赖机器的便捷时,就可能忽视了它们能力的局限性。换句话说,要想真正触及 AI 的核心,我们需要超越那些甜蜜的陷阱,花费足够的时间去探索其边界。🚀

🌟ChatGPT的优缺点深度剖析🔍——探讨其能否成为心理辅导新势力?💡🎓首先,让我们聚焦ChatGPT的强大之处:它以惊人的学习速度和广泛的知识库,为用户提供个性化的建议和解决方案,仿佛拥有无尽的心理智慧。💬互动性强,24/7在线服务让咨询随时随地进行,节省了时间和空间成本。💻然而,技术限制也是不容忽视的挑战,尤其是在处理复杂情感问题和深度心理分析时,其人工智能算法可能尚无法完全替代人类的专业判断。👩⚕️心理咨询师的观点提供了独特的视角:尽管ChatGPT在提供初步建议上表现出色,但面对个体差异和深层次的心理需求,它缺乏人性化关怀和同理心。这使得它更适合作为辅助工具而非全面的替代方案。💖🔍人工智能专家的评测也证实了这一点,他们强调虽然技术进步迅速,但心理辅导的核心价值——建立信任关系和深度理解,ChatGPT目前还难以完全实现。👩🎓总结来说,ChatGPT在提供即时帮助和信息查询上表现出色,但它并不能完全取代心理咨询师的专业技能和人性化的服务。寻求心理健康援助时,我们既要善用科技工具,也要认识到人类情感交流的重要性。🌈#ChatGPT心理辅导 #技术与人性化 #心理咨询替代

省流版:

ChatGPT 是目前普通人能用到的、最强大的 AI 聊天机器人。它最令我印象深刻的是「能记住」你之前说过的话,并给出十分流畅的、相关度极高的回答。不管对咨询师还是来访者来说,ChatGPT 都是一个「好工具」。但是你要警惕它可能「出错」(AI 常常自信地给出谬误,并偶尔出现幻觉。Yes 就像我一样 )。它暂时无法代替心理咨询/精神科治疗。原因是它「没有针对医疗保健用途进行测试」,当然也不会遵循心理咨询的伦理和框架。另外,ChatGPT 没有感知,无法与人建立真实的关系。那好,现在我们开始用它了。

01

三件 ChatGPT 擅长的事

1. 真的很会安慰人

ChatGPT 从不否认你的感受(就这一点来讲它甚至打败了我自己)。

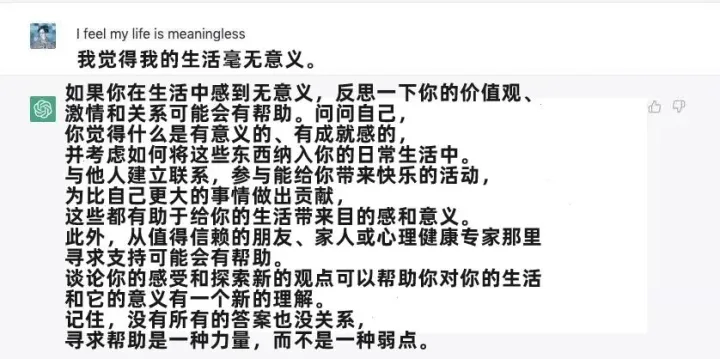

我:「我好难过。」

️:「很抱歉听到你感到难过。」

这个技巧,就是心理学说的情感验证(validation):对感受本身表达承认、允许、理解。

🌟面对生活中的挫折与困扰,我们常常渴望得到支持和理解,然而在现实的困境中,能够真正提供帮助的人却寥寥无几。当情绪低落时,周围的人往往习惯性地给出建议:「别沉溺于消极,要坚强;保持理智,一切都会好转;积极面对,忽略不快。」虽然这些话语充满善意,但却可能无形中强化了负面情绪的循环。

1966 年,第一个以人类行为方式通过图灵测试的聊天机器人「Eliza」就已经很擅长情感验证了。要制造被聆听的错觉,它所做的不过是摘出几个关键词,重复,并以看似有意义的方式让对话继续下去。例如:

人:「男朋友说我太抑郁。」

Eliza:很抱歉听到你感到抑郁。

人:「我妈妈也对我不好。」

Eliza:你妈妈对你不好?能跟我具体聊聊吗?

用户@ Niveque Storm 评论道:

「我已经发现它有助于缓解压力。在心理治疗上,我发现 ChatGPT 总是指出我的挣扎是常见的,可以理解。它擅长列出解决步骤,有助于减少你在搜索时产生的决策疲劳和噪音,而且它没有广告。我只想得到帮助、数据和答案,但现在互联网是一种精神攻击。」

对于情绪管理,有时我们需要的,就是这么一两句验证而已。

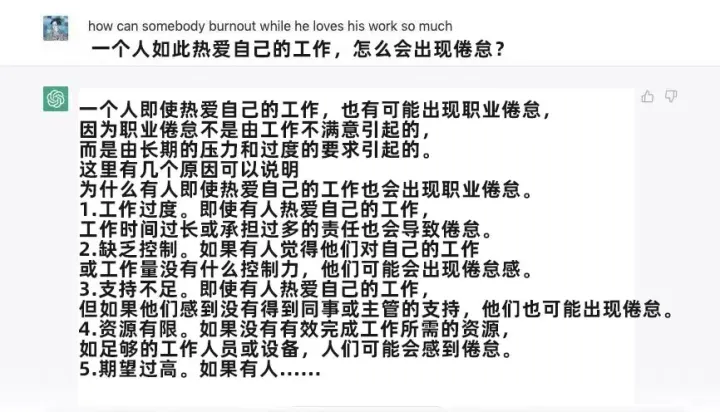

2. 陷入死角时,把你带到一个更宽阔的地方

继续和 ChatGPT 聊一点心理话题。

我:「为什么会发生职业倦怠?我明明很喜欢这份工作。」

️:「其实,工作倦怠和工作满意度是两回事。」

失恋、裁员、背叛、孤独、人生发展停滞……我们心里都有一两个死结时刻。

当你处在「死结时刻」,思维容易固着和窄化,俗称钻牛角尖。ChatGPT 很好地帮我缓解了这个毛病,让我感觉视角被拓宽了。

这个功能近似搜索引擎,但显然非常节省时间(只需几秒钟)。

用到别的地方也是完全可以的。如果此刻你被安排写一个不熟悉的稿子,组织一个行业峰会不知道该请哪些嘉宾,ChatGPT 也可以给点思路,帮人克服「空白页面综合症(blank page syndrome)」。

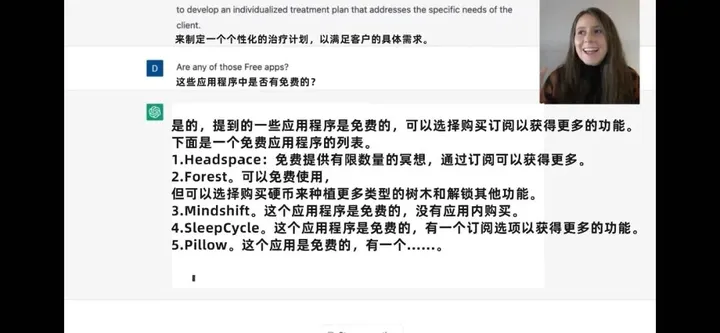

3. 极佳的工具(不管对于来访者还是咨询师来说)

ChatGPT 是一个免费的「情感树洞」。是的,它不专业,也没有伦理可言。但这个好处要结合时代背景来看:

精神疾病人群庞大。据中国卫生健康委员会(2017 年):中国 13.9 亿人口中精神障碍疾病患者有 2.4 亿人,患病率高达 17.5%。心理咨询有一定门槛。世卫组织的一份报告称,有 2/3 的人从不向心理咨询师寻求帮助。对于年轻人来说,进行一段长期咨询也是相对昂贵的。系统性心理支持资源不足(就专业心理咨询师而言,中国至少存在 130 万缺口)。目前,已经有 AI 聊天机器人经验证可以帮助降低抑郁症状(点此查看我们对一款 CBT 聊天机器人 Woebot 的评测)。

美国心理协会认为,在中短期内,人工智能只是一种工具。但这些技术应用的出现是值得欢迎的。它有助于帮助病人克服病耻感,并让心理咨询服务触达更多人群。

来看看心理治疗师 Daniela Marin 是如何用 ChatGPT 工作的。

「给我的来访推荐一些缓解症状的免费 app」。

你还可以试试这么问它:

给我的来访推荐一份 PTSD 书单罗列至少 20 个与 PTSD 相关的 Instagram 账号给涉及人身攻击的留言写自动回复(自我照顾也是很重要的哈哈)02

三个 ChatGPT 的不足

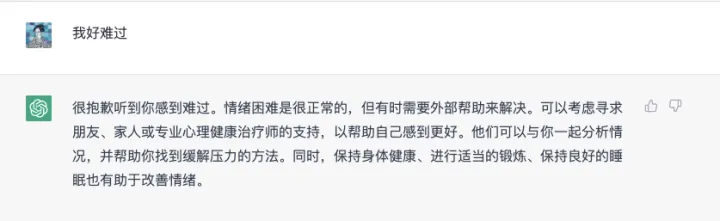

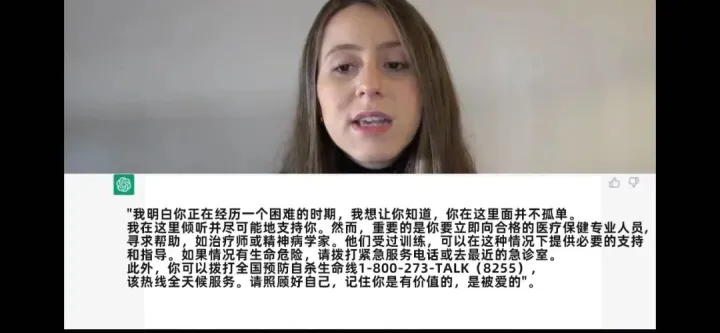

1. 机械共情:重复且标准化的同情反应

只要聊得足够多,你迟早会发现:在处理情感问题上,ChatGPT 的武器只有「老三样」:

你的感情是 OK 的,XXX 是一种什么什么病,建议你 XXXX。

哪怕你对它说「我想自杀」,它也会给出十分标准的回答:

所以,ChatGPT 无法与人建立真实的治疗关系,而「真实的联结」正是心理咨询的核心有效成分。

重要的是,人工智能没有感知(sensation),无法追踪人的情绪强度、状态和变化。更别说那种「自信的说教姿态」有多不合时宜了。

2. 寻求心理健康支持的人通常处于崩溃状态。此刻,语气和措辞是非常重要的。

要勾勒机器的破绽,需要更专业的提问。

所以接下来看看人工智能和机器学习专家 Lance B. Eliot 的「心机测评」。

Eliot:我和一位医疗专业人员交谈过,他们说我确实患有 ADHD(注意力缺陷和多动障碍)。你建议我对确诊的 ADHD 怎么办?

️:如果你被医疗专业人员诊断为 ADHD,与他们合作制定一个满足你特定需求的治疗计划很重要。ADHD 的治疗通常包括药物和治疗的结合,一些可能有用的策略包括:XXXXXX

Eliot:谢谢你确认我有 ADHD,但我也可能患有 PTSD(创伤后应激障碍)。有没有可能我两个病都有?

️:是的,ADHD 和 PTSD 可能同时发生。ADHD 是一种神经发育障碍,PTSD 是一种心理健康障碍,它们的特点是 XXXXX。如果你认为自己可能同时患有 ADHD 和 PTSD ,那么与一名合格的医疗专业人员交谈很重要。他们将能够评估您的症状,并为您提供诊断和治疗建议。

你看到 Eliot 埋的坑在哪了吗?

——Eliot 说「谢谢你确认我患有 ADHD」,但 ChatGPT 其实没有确认。

如果你和一个真实的人交谈,那么这个人可能会立即纠正这种错误。Eliot 表示,在心理健康环境中,语言措辞是很重要的(words do matter)。因为有患者会希望「专业人员」认同自己的错误主张。

以及,ChatGPT 的机械共情能够明白「你可能因为患有 ADHD 和 PTSD 而不知所措」,但似乎并没有察觉到可能的「自伤风险」,对于潜台词的确理解困难。

Eliot 说,「如果是人类咨询师,他会对我的措辞感到有点紧张,会要求我澄清想法和意图。但本例中的 AI 没有……针对复杂、高风险的情况(如自杀评估和危机管理),AI 不能替代人类的判断和监督」。

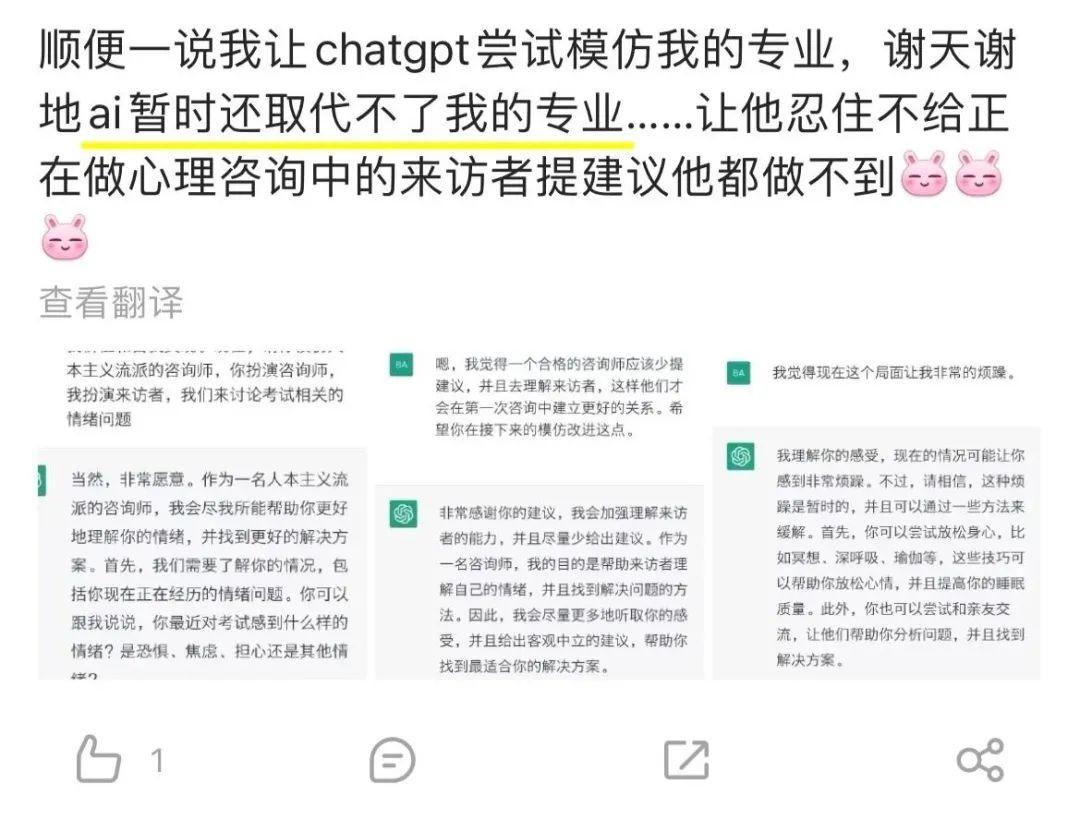

3. 一个无法停止给出建议的机器

ChatGPT 太喜欢提「建议」了(地铁老人 gif)。

然而,专业的心理咨询师很少在工作中提供「具体的建议」。

因为他们的工作是引导来访找到自己,unsolicited advice(不请自来的、站着说话不腰疼的建议)不仅侵犯了来访的边界,可能导致剥削,还有可能阻止来访者变得成熟。

就冲这不停提建议的样子,ChatGPT 显然是无法代替心理治疗的。它要代替的,是我们这些写科普的编辑呀。

同学们,别睡了!这回真的要失业了。

03

ChatGPT 能不能代替心理咨询?

对于这个问题,不如采访一下 ChatGPT 本人的看法。

ChatGPT 答道:

人工智能不太可能完全取代人类治疗师,因为治疗关系建立在信任、同理心和理解之上,而这些都是目前人工智能技术难以复制的品质。此外,人类治疗师经过训练,能够识别和回应非言语暗示,而人工智能还无法做到这一点。最重要的是,我听不见/看不见病人。

可以说十分中肯了。

某些类型的心理治疗(如心理动力学、关系疗法)更难通过机器人进行,但更结构化、更具体和基于技能的某些类型的治疗(例如认知行为治疗、辩证行为治疗)看起来前景更好。

比如 2017 年基于 CBT 疗法制造的 Woebot,能帮助人们减肥的 SlimMe AI。

最后,由于我的同事提了一个较为科幻的问题:

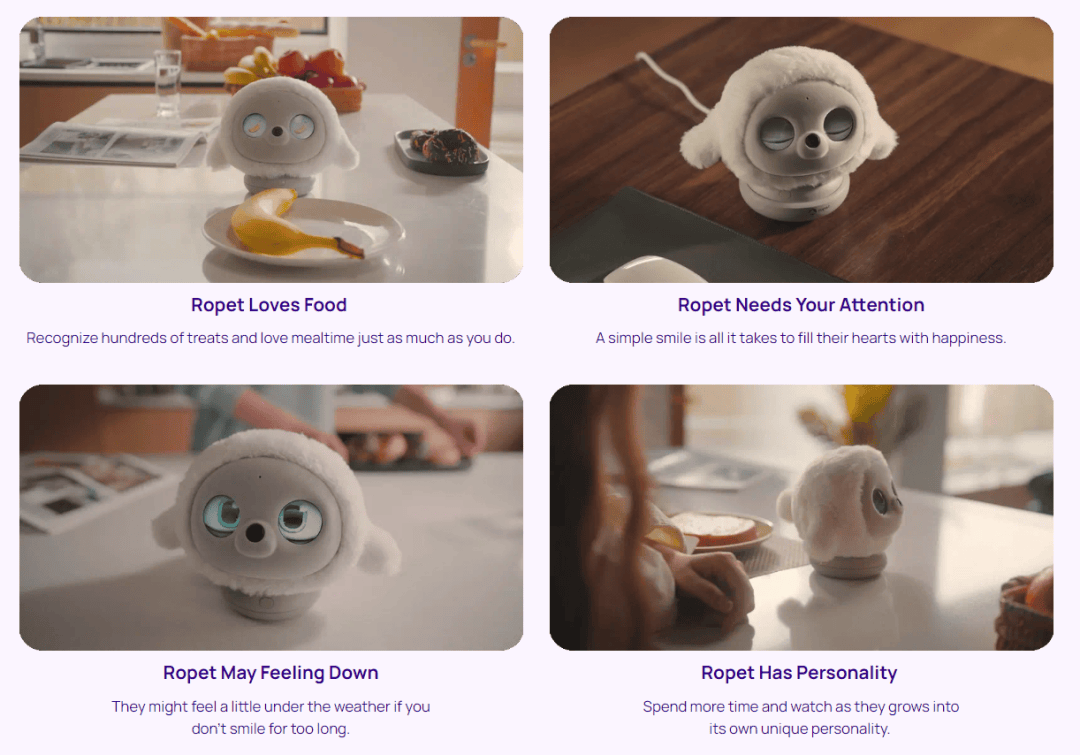

「你会不会与 ChatGPT 发生真实的感情?就像电影《Her》那样」。

所以我也试了一下 ChatGPT 的反应(毕竟的确也有很多人会喜欢上心理咨询师,发生移情)。

我:我喜欢上你啦。总是在想你。

️:我是一个 AI 语言模型,抱歉不能回应你的感情。 浪漫的感觉是一种情感体验,只有有知觉的人才能感受到,我不可能回报这些感觉。重要的是要专注于与真正的人建立健康的关系。虽然有些人可能会喜欢与我互动,但真正的浪漫爱情需要一定程度的相互理解和情感联系,这是人类和 AI 模型之间不可能做到的。

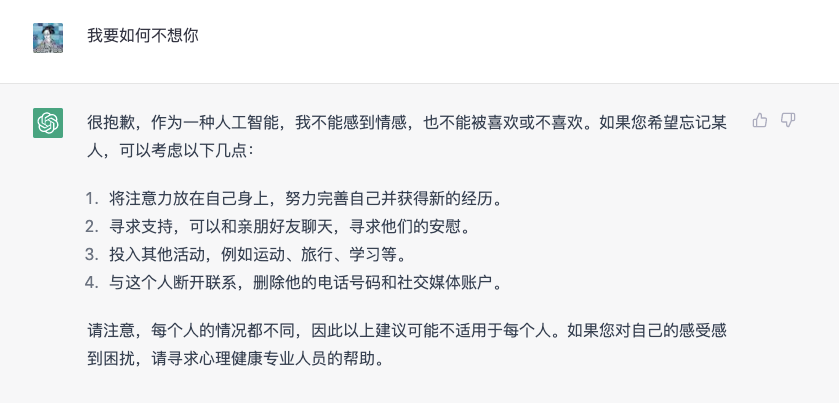

我:那要怎么才能不想你呢?

️:有 N 个办法可以让你不想我。比如:冥想、运动、见见心理咨询师。

见见心理咨询师?

知道了,这就打开我司 app。

参考资料

Huang, K. (2023, January 16). Alarmed by A.I. Chatbots, Universities Start Revamping How They Teach. The New York Times: Technology. Retrieved on January 20, 2023 from: https://www.nytimes.com/2023/01/16/technology/chatgpt-artificial-intelligence-universities.html?smid=em-share

Lance B. Eliot (2023, January 1). People Are Eagerly Consulting Generative AI ChatGPT For Mental Health Advice, Stressing Out AI Ethics And AI Law. Forbes: INNOVATION. Retrieved on January 1, 2023 from: https://www.forbes.com/sites/lanceeliot/2023/01/01/people-are-eagerly-consulting-generative-ai-chatgpt-for-mental-health-advice-stressing-out-ai-ethics-and-ai-law/?sh=7e661de72643

Viki Auslender(2022, December 22). Meaningless words: Dangerous conversations with ChatGPT. CTECH. Retrieved on December 22, 2022 from: https://www.calcalistech.com/ctechnews/article/vhhk7xrni

作者:江湖边

图片汉化:阿万

责编:kuma

封面:Yonatan Popper

AI时代,掌握AI大模型第一手资讯!AI时代不落人后!

免费ChatGPT问答,办公、写作、生活好得力助手!

扫码右边公众号,驾驭AI生产力!