近日,ACM国际多媒体会议(ACM International Conference on Multimedia,ACM MM 2024)上组织的多模态与可靠性情感计算研讨会MRAC 24(Multimodal, Generative and Responsible Affective Computing 2024)公布论文接收结果,社交平台Soul App研究成果《Multimodal Emotion Recognition with Vision-language Prompting and Modality Dropout》(基于视觉语言提示与模态暂退的多模态情感识别)成功入选。

作为较早思考将AI应用于社交领域的平台,Soul积极推动AI情感互动能力的研究,目前相关技术已应用于异世界回响、AI苟蛋、群聊派对等AI陪伴、AI辅助的创新场景。此次入选也意味着,继其推出的AI应用/功能得到的用户认可之后,Soul的底层技术能力建设和布局方向也得到了行业和学界的认可。

近年来,情感计算一直都是人工智能方向研究活跃的领域。在多媒体处理、分析与计算领域最具影响力的国际顶级会议,同时也是中国计算机学会推荐的多媒体领域A类国际学术会议 ——ACM(国际多媒体会议)上专门举办多模态与可靠性情感计算研讨会(MRAC24),正是源于学术领域对情感计算在人机交互领域发展、实际应用的关注,因此吸引了众多知名高校、学者、科技企业的目光。

不久前,人工智能领域顶级的国际学术会议之一国际人工智能联合会议(International Joint Conference on Artificial Intelligence,IJCAI)上组织的多模态情感识别挑战赛MER24同样也是情感计算在当下备受关注的一个缩影。由来自清华大学、中国科学院自动化研究所、帝国理工学院、奥卢大学、南洋理工大学等高校的多位专家学者发起的MER24上,设置了SEMI(半监督学习)、NOISE(噪声鲁棒性)、OV(开放式词汇情绪识别)三个赛道,共有来自知名高校、科技企业等近百支队伍参赛。其中,Soul语音技术团队凭借平台扎实的技术能力积累和创新技术方案,在难度最高、竞争最激烈的SEMI赛道中获得第一名。

《Multimodal Emotion Recognition with Vision-language Prompting and Modality Dropout》一文中核心介绍了Soul团队为提高情绪识别的准确性和泛化性能,提出的多模态情绪识别方法。

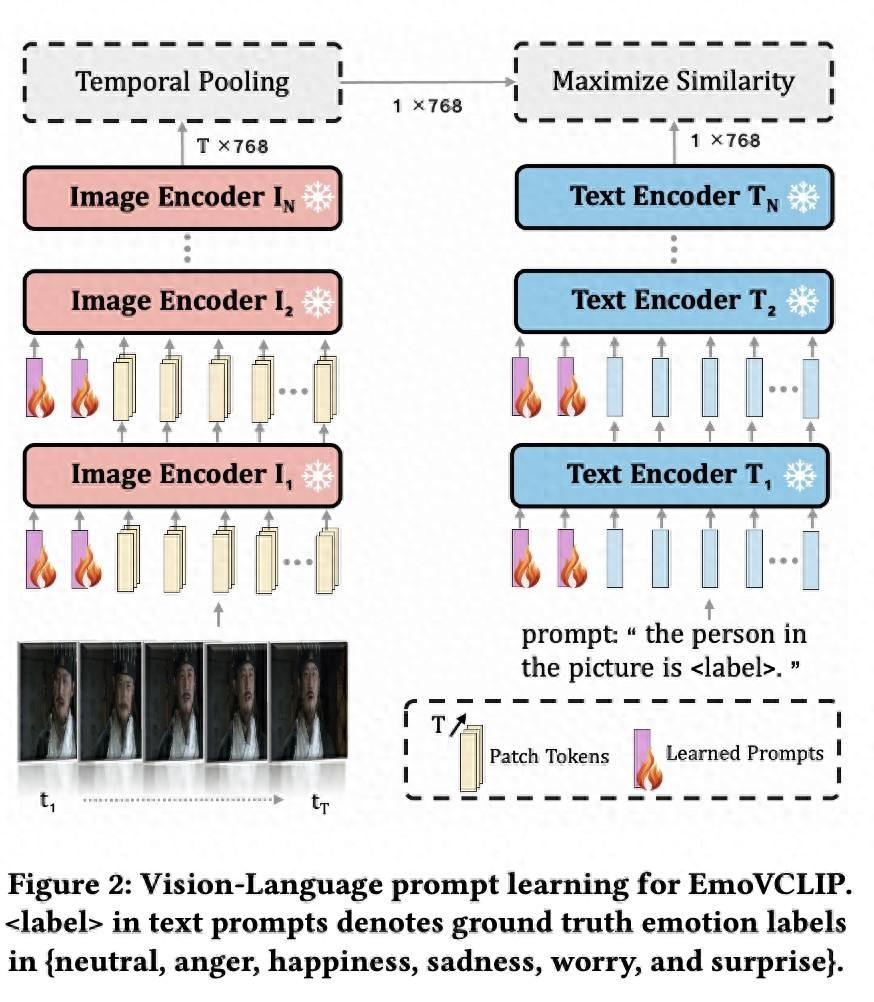

首先,Soul提出了基于视觉语言提示学习的微调模型EmoVCLIP,用于基于视频的情绪识别任务。为了提高文本模态情感识别能力,团队针对文本模态使用 GPT-4 打情感伪标签,充分利用 GPT-4 的情感关注能力,提高文本模态在情感识别的准确率,为后续进一步模态融合打下基础。

此外,为了解决多模态融合中的模态依赖性问题,团队采用 Modality Dropout 策略来进行鲁棒信息融合。最后,Soul使用自我训练策略来利用未标记的信息。实验结果表明,Soul的模型在测试中上达到了90.15%的准确率,在MER2024-SEMI赛道中排名第一。

MER2024-SEMI赛道比赛结果

Soul App CTO陶明表示,“在整个AI赛道上我们有两条主线,一条主线是辅助社交,辅助人和人的双边关系,用AI去加强人的表达,提升关系网络建立的效率和质量;第二条主线,是探索人机互动,我们认为未来所有的社交形式都会发生变化,要在人机互动这个方向探索AI情感式陪伴。”

为让AI更好“理解”人,实现有情感、有温度的人机交互,Soul持续推进相关研究和技术积累工作,此次论文也是平台阶段性研究成果和能力的总结之一。现阶段,Soul已积极将相关技术能力应用于异世界回响、AI苟蛋、狼人魅影等多个社交场景,为用户带来更好的交互体验和陪伴感。

例如,在AI互动场景“异世界回响”,拥有多模态情感互动能力的自研大模型支持下,个性化的智能体能够根据用户的语音、文字等信息实时识别情绪,并快速给予相应的情感反馈。据了解,团队目前还在探索在群聊派对、兴趣群组等社交场景中引入情感化AI能力,辅助关系网络建立,提升社交体验。

如今,AIGC技术已广泛应用于各行各业,并在提效方面展现出了惊人的效果。但在强调情绪价值的社交领域,除了提效,AI情感互动能力带来的差异化体验,或将成为AI社交方向下一阶段竞争的焦点。对Soul来说,接下来,将继续加大技术投入,持续探索AI情感互动能力在社交场景的深度融合应用,致力于构建人机交互新场景的同时,真正实现人与AI的双向情感智能交互。