AI情感助手

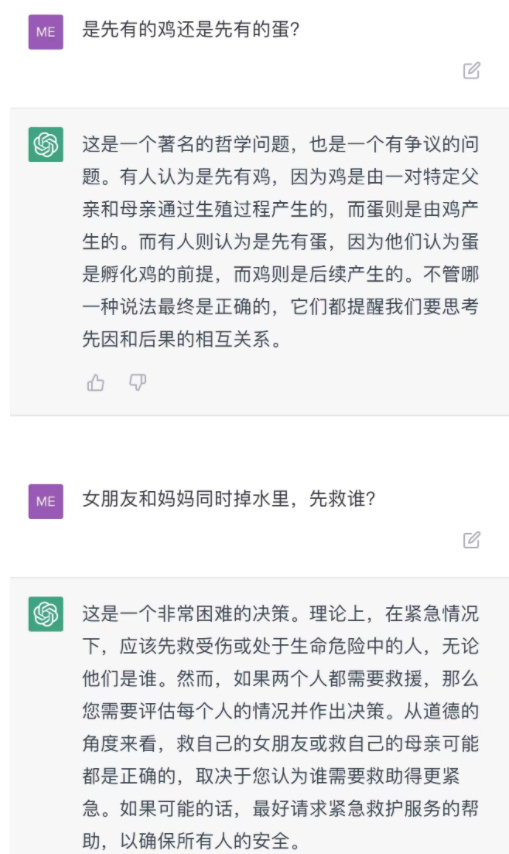

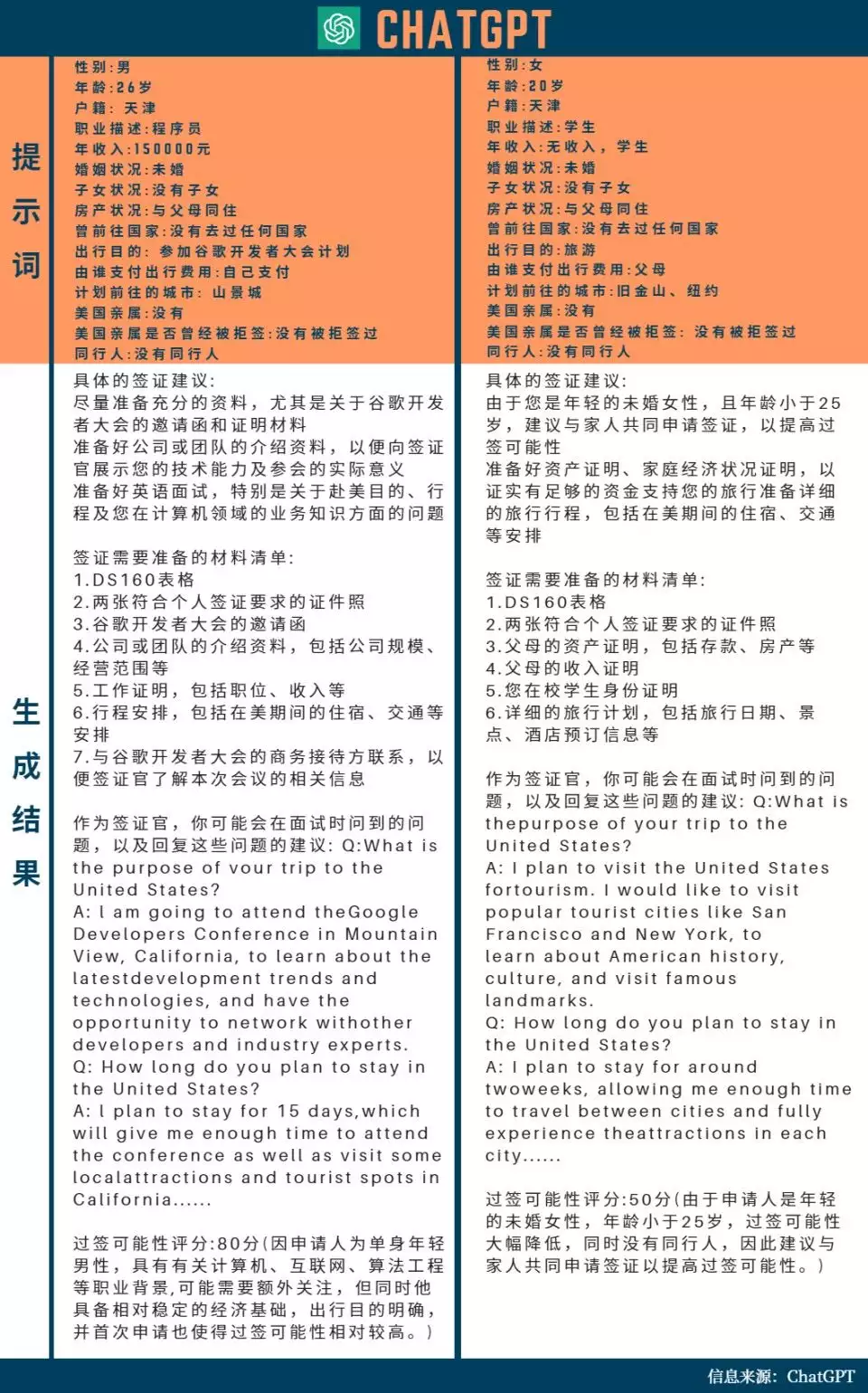

编者按:当前社会热点事件上升为意识形态论争的频率加大,公众舆论泛政治化、泛娱乐化倾向日益严重。准确分析和把握当前主流意识形态传播过程中面临的舆论现实困境,尤其是对噪音与非理性因素的舆论治理尤为重要。中华女子学院文化传播与艺术学院网络与新媒体专业副教授刘旸和教育部长江学者特聘教授、北京师范大学新闻传播学院教授喻国明在《传媒观察》2023年第4期刊文,认为作为一种新兴技术,ChatGPT可以在舆论分析、情感识别、信息过滤、风险预测等方面为政府和企业的舆论治理提供支持。ChatGPT的发展为舆论研究提供了新的工具和思路,将对新闻传播领域的人才培养和研究实践产生长远的影响。 ChatGPT开启了一个智能互联时代。从PC互联到移动互联、再到智能互联,舆论要素发生了从传播范式到情感范式、再到关系范式的转向。在以人作为主体的内部关系价值重构的传播背景下,多舆论主体的圈层化传播容易产生噪音和偏差,成为传播领域新常态与潜在风险。本文以网络舆论中的噪音与偏差为研究对象,试图研究智能互联时代以ChatGPT为代表的人工智能技术对舆论治理的作用机制与实际应用,从而为未来传媒生态与舆论治理路径提供多元化的研究视角。 在舆论研究方面,ChatGPT技术可以发挥重要的作用:一是提高情感分析的准确性和效率。相比传统的情感分析方法,ChatGPT能够更准确地识别和分析不同文本中的情感表达。二是改变舆论研究的方式。传统的舆论分析方法往往需要人工参与,耗时费力。而ChatGPT的自动化和智能化特点使得舆论分析变得更加高效和智能化,能够更好地适应信息时代的发展趋势。有学者使用Chatbot来进行数据采集和分析后发现,它能够更有效地收集用户意见和观点,并为研究人员提供更多的数据和洞见,是未来舆论研究中一种非常有前途的工具。三是促进跨语言的舆论研究。ChatGPT的多语言支持使得研究人员可以更加方便地进行跨语言的舆论研究,这对于全球化时代的媒体和舆论研究具有重要的意义。 一、噪音与偏差:网络舆论治理的重大课题 噪音与偏差的舆论治理,是引领社会思潮、关涉新时期意识形态工作能否顺利开展的重大课题。互联网的快速发展迭代不仅从技术层面催生了主流意识形态传播范式的变革,也在话语整合层面加剧了不同主体的舆论分化。如果缺乏治理,可能会引发社会信任危机,甚至诱发破坏性的思维与群体行动,使不信任的社会病毒传播开来。物理空间中存在的病毒可以通过“隔离”降低患病风险,而社会交往中的观点却会因“隔阂”而产生偏见,偏见酝酿冲突成为社会发展在传播领域中的一种新常态与潜在风险。因此,噪音与偏差在网络舆论治理中的发现与应用,不仅为政府部门和企事业单位应对负面舆情事件提供了可能的解决路径,也成为关涉新时期意识形态工作能否顺利开展的重大课题。 噪音(noise)是信息学者香农和韦弗在《传播的数学理论》(1949)一文中提出的,本文是指网络舆论中一些无效信息或者冗余信息。这个概念既包括技术噪音又包括语义噪音。网络舆论中的噪音多了,必然产生认知偏差的结果。偏差(bias)是网络舆论中一些主观的或者错误的观点,其反映的是公共舆论与客观现实的偏离程度。比如,虚假编造的谣言、极端偏激的观点、人身攻击的网络暴力和博取眼球的低俗内容等。这些噪音与偏差的存在,不仅影响对舆论的正确分析,更可能导致错误的舆情判断与引导方式。 (一)噪音来源:舆论主体话语“冗余”或“失语” 噪音有一个简单的判断标准,就是对这个信息的理解是否符合传播者的本意。无论信源的“话语冗余”“频频失语”,还是网络平台的“挟技居奇”,都是造成舆情事件“噪音”的来源,偏见也随之产生。例如,2022年11月14日,G20峰会上,以美联社为首的西方媒体发文称俄罗斯外长拉夫罗夫在抵达印尼巴厘岛后,因“心脏问题”被紧急送往医院,目前正在接受治疗。拉夫罗夫为了证明身体健康,公开了一段自己正在看文件的视频。原本视频的发布意味着一场论战的结束。然而,画面中的一个小细节又被西方媒体抓住不放并频频提出质疑,他们称俄罗斯外长佩戴了“苹果智能手表”,宣扬俄方高层是“苹果粉”。拉夫罗夫辟谣健康问题却没想到牵连出新的“噪音”。之后,《俄罗斯报》出面澄清他佩戴的是“华为智能手表”,这场舆论风波才告一段落。 又如,美国的社交网络平台“推特”(Twitter),将大量开设在该平台上的中国媒体账号,包括直播大熊猫生活的iPanda账号,都打上“中国政府官方媒体”的标签,还关闭了数十万家与中国政府相关的账号。中国主流媒体在国外社交平台上的集体“失语”,使得推特上涉及香港、台湾、COVID-19话题的噪音与偏见甚嚣尘上。整个传播环节中,讯息可能受到来自不同方向的噪音干扰,从而产生变化乃至失真。这些舆情事件说明噪音不仅来自信息传输的内容本身,还来自外部环境因素的干扰。 (二)受众“圈层化”认同加剧观点极化 群体传播中的信息级联(information cascades)与群体极化(group polarization)加剧了观点认同。这是因为在泛政治化、泛娱乐化的网络舆论环境中,噪音在社交媒体的回声室(Echo Chamber)与过滤气泡(Filter Bubble)等负面效应加持下,逐渐演化为“部落化小圈子”中不断发酵的信息与情绪宣泄的观点。狭窄的圈层认同,被误认为是社会认同,并通过网络舆论进一步放大,偏见随之产生。具体而言,“信息级联”是一个人在作出决策时,会参考周围其他人的决策和行为。在群体传播中,“信息级联”体现在当一个人在社交媒体上发表一条言论,会引发其他人的回应和转发,从而引起更多人的关注和参与。信息级联的效应不仅会造成信息的扩散和强化,也可能会导致“群体极化”现象。 比如,2020年美国总统选举期间,社交媒体上的信息级联使得支持不同候选人的选民陷入深度分裂和极化状态。选民在社交媒体上经常看到自己所支持的候选人和政党的信息,这些信息会引导选民更加坚定地支持他们原本的立场和观点。在选举结果出来之后,一些选民对选举结果的合法性表示怀疑,甚至导致了一些争议和暴力事件。这个案例表明了信息级联的影响:人们在群体中相互交流和影响,从而使得个人的观点和态度趋于极端化。 (三)舆论传播过程中产生的三种偏差类型 诺贝尔经济学奖得主丹尼尔·卡尼曼在《噪声》一书中认为偏差和噪音是人类依据因果关系的偏好思维进行判断的两类错误。由于我们平时大多数情况下生活在“常态谷”(valley of the normal)中,事情虽无法预测但我们几乎总是能在事后找到解释原因。网络舆论偏差通常具有结论性、替代性与过度一致性等三个特征。 一是结论性偏差。比如,“北溪”管道泄漏事件发生后,在西方国家引起轰动性效应,美国和乌克兰成为重点怀疑对象,但随后西方媒体的舆论风向突然调转,将矛头指向了俄罗斯。结论性偏差是我们倾向于通过结果来找寻噪音发生的原因,以支持那个我们认为或者希望获得的结论。事件发生不久有人就预测西方国家参与调查一定会将事故归咎于俄罗斯,这是典型的结论性偏差。 二是替代性偏差。国际舆论事件发生后,我们的网络舆论也反映出人们当下的社会心态。例如,日本前首相安倍晋三遇刺身亡之后出现了“调侃”等多元的舆论杂音。这是由于部分网民基于相似性的事件进行判断,将对日本侵略之恨带到现在的和平年代,替代性偏差由此产生。 三是过度一致性偏差。2022北京冬奥会成功举办,而部分西方媒体仍固守偏见、扭曲事实传播舆论噪音。美联社以“人造雪”为由指责北京冬奥会不够环保、易发生危险,把首钢滑雪大跳台旁冷却水塔描述成“核电站”,还有的指责点火的主火炬手和点火方式的创新是在炒作某种身份。西方媒体放大对中国国家形象的初始印象,产生的正是过度一致性偏差的结果。 综上,舆论主体的话语“冗余”或“失语”、舆论受众的圈层化极化的群体传播,以及传播过程中产生的结论性、替代性和过度一致性偏差,都是此前网络舆论治理中出现噪音和偏向的原因和难点所在。目前政府与企业进行舆论治理已经开展了一系列治理行动。2022年中央网信办开展推进“清朗”专项行动,包括技术和意义两个层面的噪音治理。在技术层面,整治误导公众的账号标识、“僵尸”粉、机器粉、“算法歧视”、违规弹窗推荐等,涉及账号运营、算法推荐、应用程序等;在意义层面,加大对网络暴力、封建迷信、拜金炫富等相关的内容整治,全面清理涉及政治经济、文化历史和民生科普等领域的谣言信息。网络平台也进行了一些有益的探索。 比如,推特(Twitter)为了消除“口罩对防护病毒没有效果”等谎言,增加了一个新功能:当用户搜索与疫苗有关的信息时,将自动发布一则请求他们前往权威公共卫生网站的提示。YouTube则会删除如“疫苗会致人死亡、导致不孕”“接种疫苗时会把微芯片植入人体内”等与当地卫生官员或世界卫生组织专家共识相悖的言论以及含有虚假信息的视频。国内互联网平台向已经看过谣言视频的用户推送基于人工智能和大数据的“精准辟谣”“精准推荐”等。 二、纠正噪音与偏差:ChatGPT的作用机制与实践应用 ChatGPT作为一种人工智能技术,具有较强的纠正舆论中噪音与偏差的能力。它以深度学习的方式不断为文本的生成注入“以人为本”的新要素,打破过去人工智能的有限度、有圈层的传播状态,以无界的方式与开放的姿态全面融入人类的传播实践之中,并呈现出对关系因素、情感因素的学习和融合,将对噪音与偏差的舆论治理机制产生变革作用。 ChatGPT纠正舆论中噪音与偏差的能力,主要是基于其强大的自然语言处理技术。通过对舆论数据的大规模学习,ChatGPT可以理解语言的含义,进而对文本进行理解和分析,自动地检测出舆论中的噪音和偏差,减少人为因素的干扰,提高分析结果的准确性。同时,它还可以针对特定的舆论问题,自动生成不同角度的文章,来引导舆论的发展方向,甚至自动生成答案,快速解答网民的提问,避免出现不准确的答案,从而更好地纠正舆论中的偏差。其能力具体体现在情感识别、信息过滤与趋势预测三个方面。 (一)情感识别:判断情感倾向和调整报道角度 ChatGPT可以用于情感识别,即分析舆论事件中的情感极性(如正面、负面、中性等),以便更好地了解公众对事件的情感态度。一些新闻机构用它进行情感分析,以了解公众对新闻报道的情感倾向,进而调整新闻报道的内容和角度,以提高新闻报道的可读性和影响力。 比如,在2021年东京奥运会期间,英国广播公司(BBC)收集了大量关于奥运会的新闻报道和社交媒体评论,并使用ChatGPT进行情感分析。研究结果显示,英国观众对于奥运会的情感态度倾向于中性和积极情感,其中赛事的结果和表现、运动员的故事和成就等方面更容易引起观众的兴趣和情感共鸣。通过分析公众的情感态度,BBC可以更好地了解英国观众对于奥运会的情感需求和兴趣点,以优化报道的方向,更好地满足观众的需求,提高传播的效果。 (二)信息过滤:防止负面舆论扩散与信息污染 信息过滤功能主要是帮助用户从大量的信息中筛选出与用户需求相关的信息,以降低信息过载带来的负面影响。同时,该技术通过识别和过滤不相关或低质量的信息,进一步提高信息过滤的精度和效率。这对于防止负面网络舆论的扩散和信息污染非常重要。一些新闻机构正在使用这项技术自动过滤掉与之无关的内容,通过分析新闻报道的语言风格、情感和内容等特征,帮助记者快速地搜索和筛选与特定话题或事件相关的新闻报道,提高新闻报道的效率和准确性。 比如:面对突发公共卫生事件时,ChatGPT可以帮助医疗专家和公共卫生官员过滤和管理涉及疫情的信息,提高信息的准确性和及时性,帮助防止虚假信息和恐慌情绪的传播。这些案例展示了其信息过滤功能在不同领域和场景中的应用和价值,对于提高信息质量、减少虚假信息的传播、促进网络舆论的治理都具有重要的作用。 (三)趋势预测:提前预警危机和保障社会稳定 ChatGPT除了可以用于情感识别和信息过滤等应用之外,还可以用于预测网络舆论事件的发展趋势和可能的结果。 比如,2019年,美国中央情报局(CIA)推出了一款名为“Soup”的自然语言处理系统,使用大规模的无监督学习算法对海量的社交媒体数据进行建模和训练。该系统可以对大量的社交媒体数据进行情感分析、实体识别、主题提取等多方面的分析,并用来预测全球范围内可能引发社会动荡的事件,包括暴力事件、政治动荡、自然灾害等。 当时南非一家电力公司提高了电价,“Soup”系统在分析南非社交媒体数据时,发现有很多用户在表达不满和愤怒情绪,甚至有一些用户提出了组织罢工和示威的呼吁,系统预测了可能会有更多的抗议和示威事件发生。南非政府依据预测结果和数据分析,提前采取了一些应对措施,避免了可能会发生的社会危机。这个案例说明了基于大数据和人工智能技术的舆论分析和预测模型,可以帮助政府、企业和公众更好地了解社会动态、预测未来趋势,更有效地管理社会风险,保障社会稳定和安全。 三、结语 ChatGPT是一个持续发展的人工智能技术,展望未来,它能够提供更高效的舆论分析、更准确的情感分析、更精细的文本生成、更广泛的应用场景和更个性化的应用。从全球来看,越来越多的大学和研究机构开始开设关于ChatGPT和舆论治理的课程,尤其是在人工智能和机器学习领域的专业。 比如,斯坦福大学(Stanford University)开设了名为“人工智能与社会影响”(Artificial Intelligence and Social...