我甚至预见了ChatGPT写作者们的覆灭结局

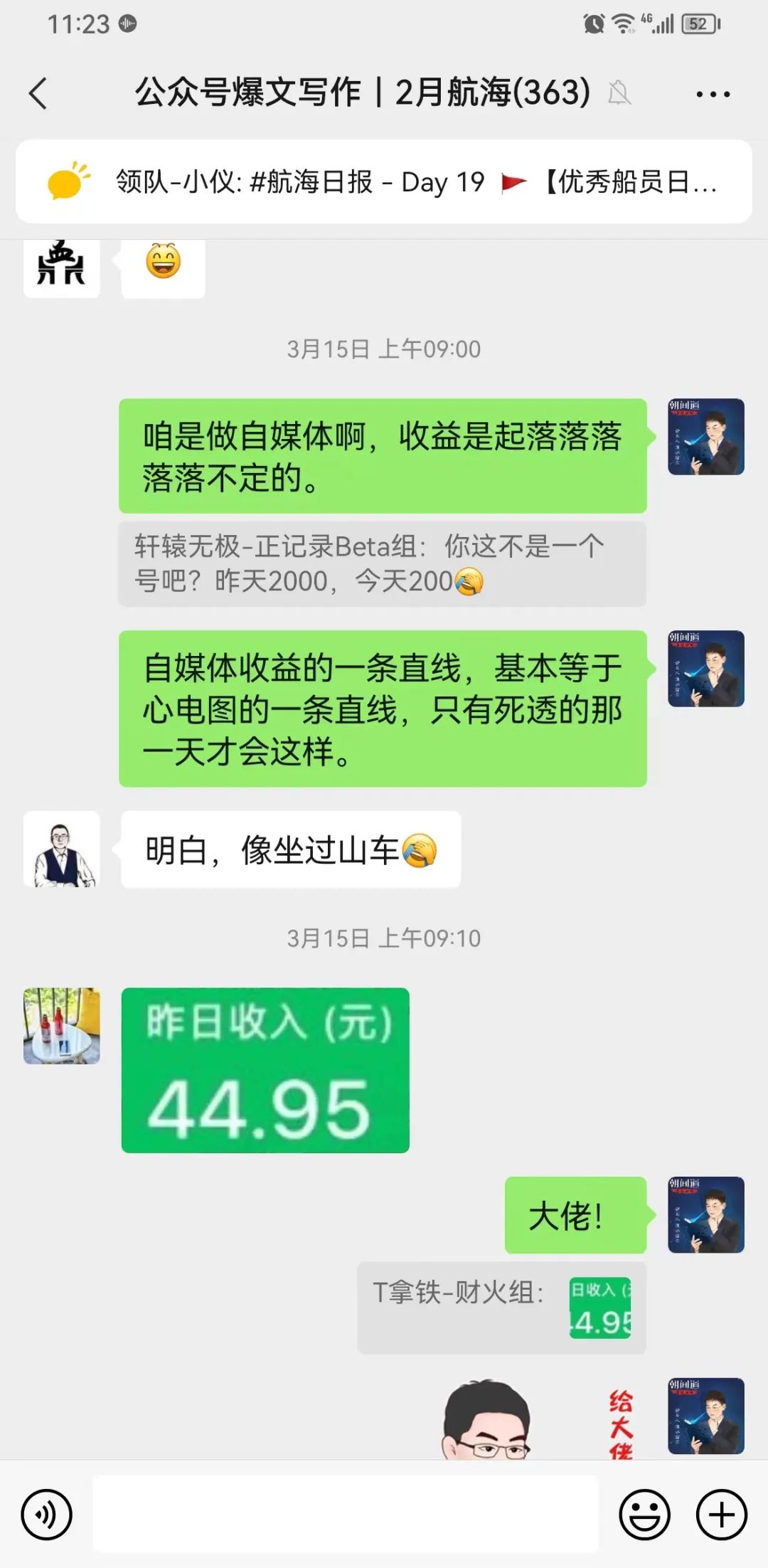

按道理来说,我身为一个又卖写作课,又卖ChatGPT课的人,我不该写这篇文章,而是应该一味吹ChatGPT好又妙,呱呱叫,那样又轻松又能多挣钱,岂不美哉。 但真相在此,就算我不开口说,早晚也得有别人说。既然如此,那还是我抢先说了吧。 这个真相就是:会有为数众多的写作者,将要因ChatGPT而覆灭。如果你觉得单靠这款工具,就能轻轻松松写出爆款,赚到钱,那可就大错特错了。 想要写出爆款,我们必须知道,爆款是怎么来的。 比如社会热点爆款,背后往往是大众的恐惧、愤怒和渴望,最终将某些偶发事件,一口气顶上来热榜,最终将其促成了热点事件。 再比如,法律案例或情感故事,如果它们能爆,大概率是激起了大众的某些共鸣,从而使其成为了爆款,这就是爆款的基础原理。 谁能理解大众的需求?答案是,只有人类作者才能做到,单靠AI工具,是万万做不到的。 每个爆款,都得益于创作者的情感敏感度、自身的生活体验,以及过往的写作积累。如果一个作者,本身就对这些缺乏理解和把握,那么他就算拥有ChatGPT这样的强大工具,也是无能为力的。 AI工具,无法完全理解,和把握人类的情感、情绪和需求。至少今天,它还做不到这一点。 所以,我才会在朝闻道写作社群之内,写下了几十万字的课程,来方便大家理解爆款的原理。但这些按部就班的内容,仍然被很多人忽视了。 毕竟,ChatGPT可比它们快多了呢。人生苦短,谁不希望能“快”一些呢? 就算是初步掌握了爆款的规律,恐怕作者仍然无法逃离覆灭的命运。或许在ChatGPT的促成之下,这个局面很快就会出现了。 那个致命的病根,就是读者的审美疲劳了。 ChatGPT虽然能快速写下丝滑的内容,但在创新性和多样性上,它存在固有的局限性。尽管AI可以学习和模拟各种文本风格,但最终生成的内容,往往会趋于一种“平均”状态。 这种“平均”状态的内容,尽管在质量上可靠,但长期以来,读者们可能会因为内容的单一性而感到厌倦,从而产生审美疲劳。 你有高达,别人也有。你觉得自己能赢,但别人又能怎么输? 基于ChatGPT等AI工具的便利性,越来越多的作者,可能会选择使用这些工具进行创作。这便会导致大量相似风格的作品涌现,从而大大加快了审美疲劳现象的出现。 到最后,就是流量断崖式下滑,收益腰斩,当读者们对于内容产生厌倦,作者们可能会感到挫败,从而影响他们的创作。在此之后,作者们可能会选择放弃创作,从而进入“覆灭”的必然结局。 既然我们已经提前预见了这个结局,那么就必须,要防患于未然了。 在说方法之前,我们有必要先明确一个概念,自媒体创作者的收益,是起起落落,飘忽不定的。只要你在场里一天,就要承受它所带来的颠簸。 它就像是心电图一样,如果哪天不颠簸了,就意味着你这个号挂掉了。 很多作者,比如我,能从听书稿时代坚持到如今,无外乎是因为,我比别人多踩了几个向上的波峰,多赚了几波真金白银而已。 什么自律,都是扯淡。如果没钱,老子第一个就摔耙子不干了,还自律个屁啊。 我们未来的ChatGPT写作之旅,注定也是一段不断颠簸的旅程。而我们写作变现的思路,必然也要不断升级,不断迭代,不断去寻求全新的流量密码,这样才能踏上一个又一个的波峰,从而比别人走得更远。 你无需成为王者,你只需成为剩者,便已经能吊打绝大多数的人了。 拼来拼去,拼的其实是ChatGPT背后的那个人,仅此而已。 我们需要不断迭代思路,研究“很新的爆款”,和“最新的流量密码”,甚至还要学习“全新的观点”。只要你肯拿这些喂养自己的ChatGPT账号,你自然而然地,就走到了时代的前列。 你需要在好的圈子里,与很多朋友并肩作战。正所谓,“众力并,则万钧不足举也;群智用,则庶绩不足康也。”当你每天,都能得到一群熟练作者的智慧滋养,那又当如何? 相信在我们的努力下,我们朝闻道写作社群,就将成为这样的圈子,也将把更多的前沿智慧,应用到未来的ChatGPT写作当中去。 (完)