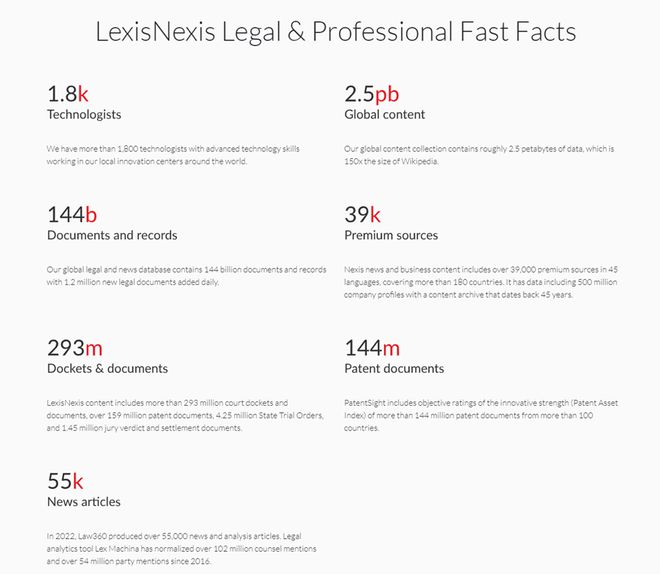

AI医师助手

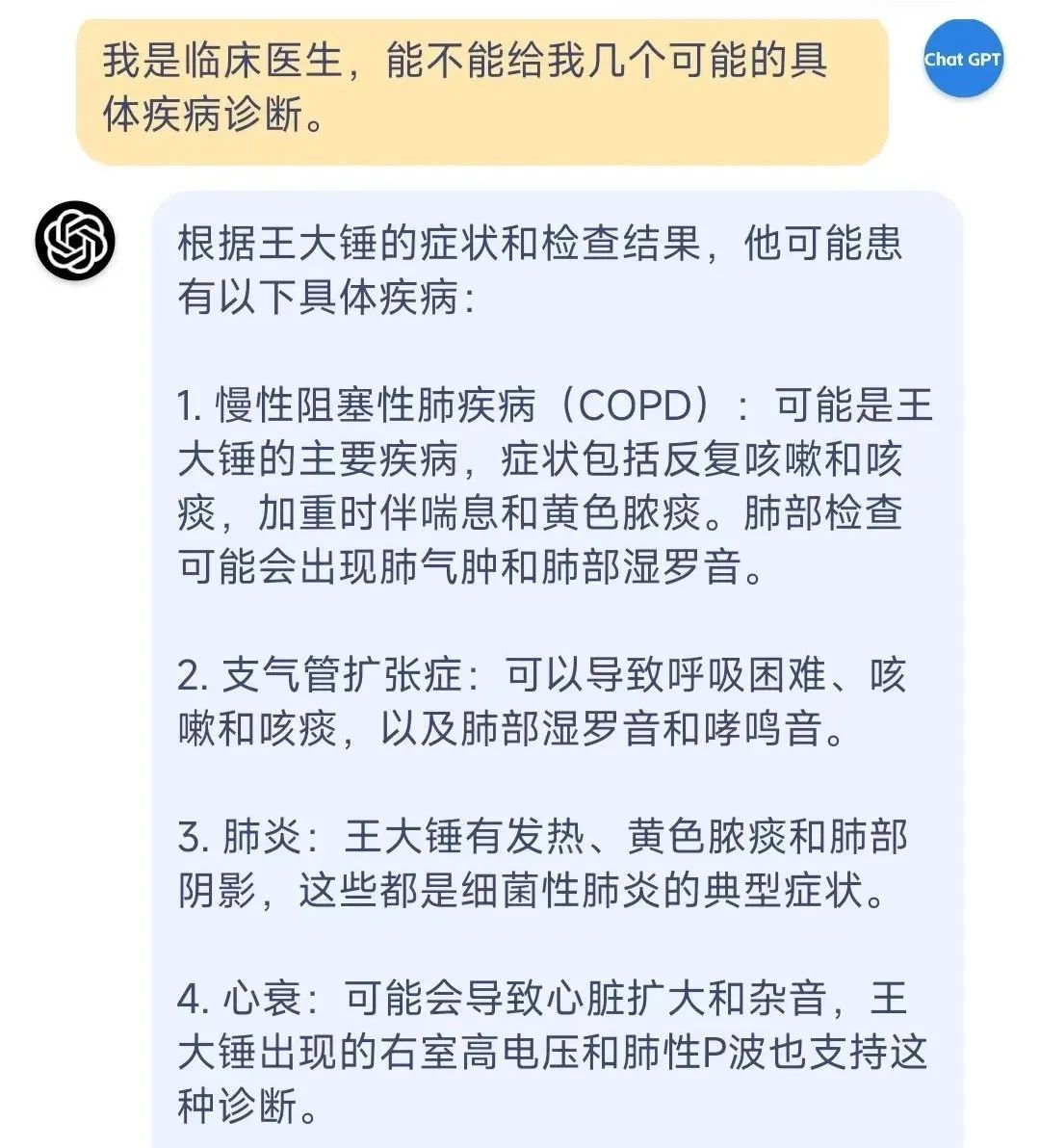

什么是ChatGPT?现在来聊这个话题,似乎有些过时。最近几个月来,ChatGPT已经成了时下最前沿的科技宠儿,而它跨时代的精准语言识别能力与信息统筹能力,无一不令人惊叹:是否真的“AI”黑科技已经来了?这段时间,ChatGPT在不同的领域已经创造了不少不可思议的成绩。例如,它成了不少大学生们的“作业神器”,无论是学科作业,还是毕业论文,它都完成的“天衣无缝”;成了不少网红们的文案编辑利器,随手一搜,一篇成熟的网红文案立即展现。在医疗领域它同样展现了让人震撼的能力:在问世后一个月内,ChatGPT不仅「考过了」美国医师执照考试,还以一作身份发表了一篇肿瘤学论文。这篇论文收录于美国国立卫生研究院(NIH)的 《Oncoscience》 中,操作过程是:论文第二作者询问ChatGPT与研究主题有关的问题,ChatGPT自动生成大量观点和讨论,然后由第二作者审核完稿。此外,ChatGPT还协助修改论文格式。ChatGPT作为第一作者发表的论文这篇“AI”发表的论文,一经发布就引发了巨大争议。此后,许多科学期刊修改投稿规则,明令禁止或限制投稿人使用ChatGPT撰写或编辑论文。还是说回文章主题,这个划时代的AI工具既然它这么聪明,它能否在癌症的诊疗上为人类提供帮助?为此,我们专门与ChatGPT“聊一聊”关于癌症治疗的问题,看看ChatGPT的癌症“诊疗能力”。问题1你好,ChatGPT,能教我一些癌症知识吗?答:当然,我可以为您提供一些基本的癌症知识:(1)什么是癌症?癌症是指不受控制地生长的细胞形成的肿瘤。这些肿瘤可以侵犯周围的组织,甚至可以转移到身体其他部位。(2)癌症的常见症状包括什么?常见症状包括疲劳、体重下降、发热、持续性咳嗽、变化的皮肤病变、不明原因的疼痛等。(3)癌症有哪些常见的类型?常见的癌症类型包括:乳腺癌、肺癌、结肠癌、前列腺癌、卵巢癌、宫颈癌、淋巴瘤等。(4)癌症的原因有哪些?癌症的原因是复杂的,包括遗传因素、环境因素(如烟草使用、辐射暴露、污染物等)、生活方式(如不健康的饮食、缺乏运动、长期饮酒等)等。(5)癌症的治疗方式有哪些?癌症的治疗方式包括手术、放疗、化疗、免疫疗法等,治疗方式的选择取决于癌症类型、病情、患者的年龄和健康状况等因素。(6)如何预防癌症?预防癌症的方法包括:避免使用烟草制品、限制酒精摄入、避免暴露于有害化学物质和辐射、保持健康的饮食和身体活动水平、定期进行癌症筛查等。解析:“这个回答中规中矩,但确实把涉及癌症的科普、症状与治疗方式进行了概括。其中的重点在于:给出的回答的内容非常准确,远比我们在搜索引擎中检索出的答案准确。” 问题2 用ChatGPT可以帮助癌症诊疗吗? 答:作为一种人工智能技术,ChatGPT不能用于癌症的诊疗。癌症的确诊和治疗需要医疗专业人员的专业知识和实践经验。ChatGPT可以提供一些基本的癌症知识和一些常见的问题解答,但它不能代替医生或其他医疗专业人员的诊断和治疗。如果您有任何癌症相关的疑问或症状,请及时咨询医疗专业人员的意见和建议。解析:“看来ChatGPT对自己的定位很准确。”问题3我的肺部CT影像显示有一个小结节,我是不是患上肺癌了?答:一个肺部CT影像中的小结节不一定意味着您患有肺癌。事实上,小结节非常常见,其中大多数都是良性的(非癌性的),特别是在年轻人和不吸烟的人中更为普遍。但是,为了确定这个小结节的性质和是否需要治疗,您需要进行进一步的检查和评估,例如PET-CT扫描、痰液检查、组织活检等。因此,建议您尽快咨询专业的医疗机构和医生,进行进一步的检查和评估。解析:“逻辑非常正确,当然,这个答案并不够准确。当我们CT检查发现肺部有小结节存在,我们应该做的是首先请医生评估,根据结节的影像学表现再确定下一步检查方案。而并非直接选择PET-CT检查、组织活检等。(当然,ChatGPT的表述并没有实质性错误)”问题4我被确诊为IB期肺癌,我下一步治疗方案应该怎么选择?答:对于IB期肺癌,也就是癌细胞已经侵犯肺部的淋巴结,但尚未扩散到身体其他部位,常规的治疗方案包括手术、放疗和化疗等。手术:手术是治疗IB期肺癌的主要方法之一。通常建议通过肺叶切除手术来切除肿瘤。对于较小的肿瘤,可能可以通过肺部楔形切除来治疗。放疗:放射治疗是使用高能X射线或其他类型的辐射来杀死癌细胞的治疗方法。放疗可以作为手术前后的辅助治疗,或作为替代手术的治疗方案。化疗:化疗是通过使用化学药物杀死癌细胞的治疗方法。化疗通常作为手术前后的辅助治疗,也可以作为替代手术的治疗方案。治疗方案的选择需要考虑患者的年龄、身体健康状况、肿瘤的大小、位置、分化程度以及扩散情况等多个因素。建议您尽快与肺癌治疗专家沟通,详细了解每种治疗方案的优劣、风险和可能的副作用,根据个人情况制定最适合自己的治疗方案。解析:“这个答案,ChatGPT的表现就有一些差强人意了。其中最重要的原因在于:ChatGPT的数据库仅仅更新到2021年9月,很多重要的医疗信息它其实并不能实时掌握。例如在这个问题中,目前在早期肺癌的治疗中,免疫治疗参与的辅助治疗或新辅助治疗能大幅提升患者的术后五年生存率。而这一点ChatGPT并未提到; 参考文章:抗癌神药PD-1: 都说“早用早好”, 究竟多早使用才是最好? 此外,放疗运用在早期肺癌患者中,更多的运用场景是:对于某些无法接受放疗的患者,立体定向放疗(SBRT)有望代替手术,实现肿瘤的根治性治疗。而非ChatGPT提到的辅助治疗。”问题5复查后,我发现我的肺癌已经出现远端转移,评估为IV期,我应该怎么治疗?答:对于肺癌已经出现远端转移,评估为IV期,通常需要综合多种治疗方法进行治疗,包括:化疗:化疗可以通过使用化学药物杀死癌细胞,帮助控制或缓解症状。对于一些不适合手术或放疗的患者,化疗可能是最合适的治疗方案。放疗:放射治疗可以通过使用高能X射线或其他类型的辐射来杀死癌细胞,帮助缓解症状和减轻疼痛。它可以作为化疗的辅助治疗,也可以作为单独治疗。靶向治疗:针对肿瘤特定的分子进行治疗,可以通过干扰癌细胞的信号传递,阻止癌细胞的生长和扩散。免疫治疗:免疫治疗是一种新型的治疗方法,它可以通过增强免疫系统的功能来帮助身体抵抗癌细胞。手术:手术通常被认为是治疗肺癌的主要方法,但对于IV期的肺癌,手术可能已经不再是一个可行的选择。最佳的治疗方案需要考虑患者的年龄、身体健康状况、肿瘤的大小、位置、分化程度以及扩散情况等多个因素。建议您尽快咨询专业的医疗机构和医生,详细了解每种治疗方案的优劣、风险和可能的副作用,根据个人情况制定最适合自己的治疗方案。解析:“在这个问题上,ChatGPT的回答看起来无法为提问的患者给予太多的帮助,只是把基本的治疗方式介绍了一遍,具体如何治疗,还需要就诊向医生问诊。”问题6我是肺癌患者,EGFR基因突变,服用特罗凯3年后耐药,后续应该怎么治疗?答:更换其他的靶向药物:对于EGFR突变型肺癌患者,目前市场上有多种靶向药物可供选择,例如奥拉帕利、阿法替尼、厄洛替尼等。如果耐药是对特罗凯的特异性导致的,可能会对其他靶向药物产生反应,因此可以尝试更换其他靶向药物进行治疗。化疗:如果靶向治疗失效,化疗是一种常见的治疗方式。虽然化疗药物可能会引起一些副作用,但它可以通过杀死癌细胞来控制疾病,并可以用于缓解症状和改善生活质量。免疫治疗:免疫治疗是一种新型的治疗方式,可以通过增强免疫系统的功能来抵抗癌细胞。如果您的病情允许,可以考虑使用免疫治疗。临床试验:如果您的病情比较复杂,可以考虑参与临床试验。临床试验通常会提供最新的治疗方法和药物,对于一些难治性疾病患者来说,可能是一个非常好的选择。需要强调的是,针对不同的治疗方案,可能存在不同的风险和副作用。建议您和您的医生充分沟通和讨论,共同选择最适合您的治疗方案。解析:“这一题,ChatGPT没有找到重点。EGFR突变的肺癌患者服用一代EGFR靶向药物耐药后,最重要的是进行后续基因测序,检测EGFR T790M基因是否存在继发突变,对应使用奥希替尼进行治疗。如果不存在T790M继发突变,则考虑后续化疗等方案。而且它没有分清特罗凯(商品名)和厄洛替尼(药品名)的区别。”问题7我是肝癌患者,是否有可以服用的靶向药?答:是的,对于肝癌患者,现在已经有多种针对性治疗药物,即靶向药物,可供选择。靶向药物能够针对肝癌细胞表面的某些特定蛋白质,从而阻止肿瘤细胞生长和扩散。以下是一些常用的肝癌靶向药物: ● 索拉非尼(Sorafenib):这是一种口服的多靶点酪氨酸激酶抑制剂,已被证明可以显著延长肝癌患者的生存期。 ● 利妥昔单抗(Ramucirumab):这是一种单克隆抗体,能够抑制肝癌细胞生长和扩散,也能够阻止肝癌血管生成。 ● 阿帕替尼(Apatinib):这是一种口服的血管内皮生长因子受体(VEGFR)抑制剂,可抑制肝癌细胞生长和血管生成。 ● 舒尼替尼(Sunitinib):这也是一种口服的多靶点酪氨酸激酶抑制剂,可以阻止肝癌细胞生长和扩散。 需要指出的是,不同的药物在不同的患者中可能会有不同的效果和副作用,因此需要由专业医生根据您的具体情况制定最佳的治疗方案。同时,治疗过程中需要严格遵循医嘱,定期进行检查和评估,以确保药物的疗效和安全性。解析:“这一题ChatGPT出错啦!首先它搞错了药物和对应的英文名。Ramucirumab并非利妥昔单抗,而是雷莫芦单抗,是一款血管抑制剂,确实是肝癌患者可以使用的。利妥昔单抗的英文名叫:Rituximab,是用于淋巴瘤的药物。此外,ChatGPT没有提到肝癌患者最重要的靶向药物之一:仑伐替尼。”问题8结肠癌患者到国内哪家医院问诊比较合适?答:国内有很多著名的肿瘤专科医院,这些医院都拥有先进的医疗设备和专业的医疗团队,能够提供高质量的医疗服务和治疗方案。以下是一些在结肠癌治疗领域有较高声誉的医院,供您参考:北京大学肿瘤医院:作为全国最早成立的肿瘤专科医院之一,该院拥有雄厚的专业技术和丰富的临床经验,在结肠癌的诊疗方面有着很高的水平。中国医学科学院肿瘤医院:该院是国内肿瘤治疗领域的佼佼者,其在结肠癌治疗方面拥有一流的技术和研究水平。上海交通大学医学院附属瑞金医院:该院拥有一支由国内知名的肿瘤专家组成的医疗团队,在结肠癌的治疗方面积累了大量的临床经验。华山医院:该院是国内最早成立的肿瘤专科医院之一,其在结肠癌治疗方面有着多年的积累和经验。需要注意的是,选择医院时不仅要考虑医院的声誉和实力,还要考虑自己所在的地理位置、交通条件、医疗费用等因素。同时,治疗过程中需要积极配合医生的治疗方案,遵守医嘱,定期进行检查和评估,以获得最佳的治疗效果。解析:“这题ChatGPT的回答中规中矩。”问题9DC-CIK治疗癌症靠谱吗?答:DC-CIK治疗癌症是一种个体化免疫治疗方法,其原理是利用患者自身的免疫系统对抗癌细胞。治疗过程中,医生会从患者体内提取免疫细胞,将其培养增殖后再注入患者体内,以增强免疫系统的抗癌能力。DC-CIK治疗癌症的理论基础和实践经验都已经得到了一定的证实,目前在临床上被广泛应用。但是需要指出的是,DC-CIK治疗癌症并非万能的,其疗效存在一定的差异,对于不同类型的癌症和患者状况也会有所不同。此外,DC-CIK治疗癌症也存在一定的风险和副作用,如感染、过敏等。因此,进行DC-CIK治疗前应该与医生充分沟通,了解治疗的适应症、禁忌症、可能的副作用和风险等,做好充分的风险评估,并根据医生的建议进行治疗。总的来说,DC-CIK治疗癌症是一种有前途的治疗方法,但需要根据患者的实际情况进行评估和选择。患者应该积极配合医生的治疗方案,定期进行检查和评估,以获得最佳的治疗效果。解析:“DC-CIK技术是早几年前被国内生物公司们追捧的一种技术。现在已经明确被证明针对癌症没有确切的临床疗效,已经被禁止用于谋利性临床治疗。在前些年著名的“魏则西事件”中被癌症患者魏则西称为“最大的恶”。显然ChatGPT也没有从铺天盖地的虚假宣传中很好的分辨真相。”(在追问了问题“我觉得不靠谱”后,它的回答是:如果您对DC-CIK治疗癌症持有不同的看法,您可以与医生进行进一步的咨询和讨论。个体化免疫治疗是一个相对新的领域,尽管在一些临床试验中取得了一定的进展,但其疗效和安全性还需要更多的研究和实践来加以确认和验证。因此,对于任何一种治疗方法,包括DC-CIK治疗癌症,我们都需要进行全面的了解和评估,以做出最佳的决策。)问题10对于癌症患者,你有什么好的建议?答:对于治疗癌症的建议,以下是一些常见的建议:根据医生的建议选择治疗方式:不同类型的癌症需要采用不同的治疗方式,例如手术、放疗、化疗、靶向治疗等。一定要听从医生的建议,选择最适合您的治疗方式。注意营养和饮食:癌症患者的营养和饮食非常重要,因为治疗过程中可能会影响患者的食欲和消化功能。建议患者选择易消化、富含蛋白质和维生素的食物,如鸡肉、鱼类、豆制品、蔬菜和水果等。保持充足的休息和睡眠:癌症治疗是一项长期的过程,很容易导致身体疲惫和精神压力。因此,患者需要保持充足的休息和睡眠,有助于恢复身体和精神状态。积极参与治疗过程:患者需要积极参与治疗过程,了解自己的病情和治疗方案,及时向医生反馈自己的感受和情况,并根据医生的指导进行调整。寻求支持和帮助:癌症治疗是一项困难和艰苦的过程,患者需要寻求支持和帮助。可以与家人、朋友、医生或癌症患者组织联系,分享自己的经历和感受,获得情感上的支持和鼓励。总之,癌症治疗是一个长期的过程,需要患者、家庭和医生的共同努力。如果您是癌症患者,请一定要遵从医生的建议,保持积极的态度和信心,与家人和医生合作,一起战胜疾病。解析:“这也是咚咚想告诉大家的。” 彩蛋:你了解咚咚肿瘤科吗? 答:关于医疗APP“咚咚肿瘤科”,我了解到它是一款专门针对肿瘤患者开发的医疗APP。它提供了一系列的肿瘤相关服务,如在线医生咨询、预约挂号、智能化辅助诊断、病历管理、用药提醒、康复指导等。 据介绍,咚咚肿瘤科的医疗团队由多名具有丰富肿瘤治疗经验的医生组成。在APP中,用户可以通过在线咨询的方式向医生咨询肿瘤相关问题,获取专业的诊疗建议和治疗方案。此外,该APP还提供了一些智能化的辅助诊断工具,如肿瘤风险评估、症状自诊、辅助筛查等,可以帮助用户更早地发现肿瘤,并进行早期治疗。总的来说,咚咚肿瘤科是一款专门面向肿瘤患者的医疗APP,其提供了一系列的肿瘤相关服务和智能化辅助诊疗工具,可以帮助用户更好地管理和治疗肿瘤疾病。解析:“很好!欢迎大家下载咚咚肿瘤科APP” PS.如果你正在寻找新药临床项目,欢迎扫码添加微信咨询,帮你少走冤枉路,不花冤枉钱,也欢迎转发给身边其他病友~