ChatGPT爆火!会取代律师吗?能帮忙打官司吗?专家、律师这样认为……上海法治报2023-02-16 02:48上海法治报2023-02-16 02:48

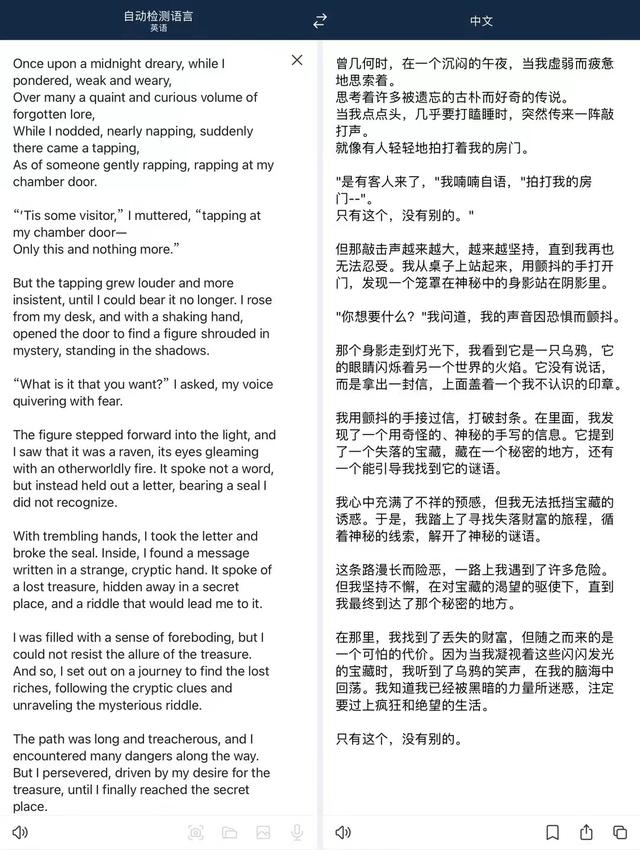

最近,ChatGPT成为了人们讨论最多的话题之一,这款人工智能聊天机器人火爆全球,除了可以用来写论文、改代码、做翻译,还能用来咨询法律问题、撰写法律文书,这不禁让人们思考:法律人会被取代吗?ChatGPT在司法领域有哪些应用场景?又有哪些掣肘?从老百姓打官司的角度是否存在实用价值?ChatGPT的风险何在?边界何在?上海法治报记者采访了四位法学专家与律师。ChatGPT可以做什么?“ChatGPT是一种大型语言模型,可以通过自然语言处理技术与人类进行交互。”上海政法学院教授曹阳介绍到,ChatGPT可以理解和产生自然语言文本,这使得它成为一个非常有用的工具,帮助人们解决各种语言理解和生成的问题。“在法律领域,ChatGPT可以演化成‘智能律师助手’,帮助律师分析大量的法律文件和案例,提供智能化的法律建议和指导;可以变成‘法律问答机器人’,回答法律问题,并提供相关的法律信息和建议。”除此之外,曹阳还指出,ChatGPT可以进行合同审核、辅助诉讼、分析法律数据等等,提高法律工作者的效率和准确性。华东政法大学知识产权法律与政策研究院研究员杨勇认为,ChatGPT对于人们学习法律概念也大有帮助。“以法律百科为基础的升级版法律知识学习可以开启智能化的法学入门学习,对全民的普法有积极意义,为建设法治社会益处良多。”此外他还表示,基于智能分析的标准化法律思维,ChatGPT还可以实现相关法律问题的初级研究,对法学师生和法律媒体人有较大的参考作用。ChatGPT不能做什么?ChatGPT对于程序问题的回答让人称赞,对于实体法律问题的咨询又是否同样称心如意?记者注意到一位涉医疗领域的律师在朋友圈吐槽,咨询专业问题,回答的“全是正确的废话,没有一句实质内容”。 上海致格律师事务所管委会主任、高级合伙人蒋秀海律师介绍,ChatGPT在回答法律咨询时,常会出现类似于免责等提示,诸如“请注意,本答案的内容仅供参考,具体情况请参考相关法律法规和政策”以及“建议您咨询当地的律师或监管机构,以确保您的行为符合法律法规的要求”。“ChatGpt的工作逻辑目前仍存在一定的局限性,特别在涉及到感性、抽象、有针对性的问题时,还是只能由人来处理。”“从目前试用效果看,ChatGPT涉及相关法律问题的回答较浅,不周延也不深入。”杨勇说道。“法律研究和提出法律问题的解决办法不同于智能写作,是极其严肃的事情,来不得半点差错。”他认为,对法律问题的研判是需要慎审对待的,ChatGPT提供的法律回答不能直接代替专业法律人的回复。曹阳也表示,目前ChatGPT技术仍然存在很大的弊端。首先,从准确性与可靠性来看,ChatGPT无法像人一样思考,无法理解法律规则背后的逻辑与价值判断,因而其结果会出现偏差。其次,ChatGPT是对理性数据的学习与运用,缺乏也无法理解人的情感,无法做到“有温度的司法”。最后,司法裁判在某种意义上是自由心证的过程,无法进行数字化的呈现,因而ChatGPT无法进行学习。ChatGPT对老百姓打官司有帮助吗?如果说ChatGPT对于专业法律人来说是一项提升效率的辅助工具,那么对于普罗大众而言,ChatGPT在处理法律纠纷的过程中能否帮上忙?蒋秀海认为,ChatGPT能够整体上提升人们获得法律服务的便利度,在一定程度上降低一些基础法律服务的成本,具有一定参考价值。杨勇也指出,非法律专业人事在不聘请代理人的情况下,可以通过简单的咨询、学习、了解,让诉讼变得简单、高效、廉价。上海市德尚律师事务所主任王凡律师表示,在诉讼过程中,普通人也可以通过ChatGPT进行法律条文、案例检索,更高效地获取到相关信息。但同时她也指出,案件各方面始终存在差异,各种抽象的法律原则始终穿插在民事行为的全过程中,机械地适用法律条文、司法判例很难做出完全准确的解答。“哪怕ChatGPT凭借海量数据库以及强大的计算整合能力,其做出的法律分析也只是具有一定参考价值,具体适用仍需进行甄别。”此外,专家与律师也指出使用ChatGPT时值得注意的一些法律风险。曹阳表示,ChatGPT需要处理大量的敏感数据,如法律文件、案例、客户信息等,如果没有进行足够的数据安全保护,可能会导致信息泄露或被恶意利用。王凡指出,ChatGPT的运作是基于数据库并进行计算整合,用户使用ChatGPT产生的成果的著作权归属以及是否属于受著作权法保护值得探讨。“ChatGPT无法保证所搜集的数据均不属于受保护的信息,因此可能会产生知识产权侵权风险,此外也同样可能无法鉴别信息的真实性、合法性等因素,可能涉及到数据合规风险。”ChatGPT的边界何在?“在司法应用领域,ChatGPT的应用存在一些边界和限制。”曹阳介绍到,一方面,ChatGPT的知识和判断能力仍然受到一定限制,它所给出的结论和建议也更多地是基于一般性的规则和原则,因此无法完全替代人类律师。另一方面,虽然ChatGPT等人工智能技术可以对大量的案例和判例进行分析和归纳,但法律是一门人文学科,需要考虑伦理、公正等因素,ChatGPT不能完全代替人类法官和裁判员的专业能力和职责,因此不能完全代替司法裁判。蒋秀海指出,ChatGPT被运用于司法领域时,更适合作为重复性、机械性工作的辅助性工具,也可借助其进行观点集成。对于具有更高价值的法律分析和解决问题工作,不宜完全依赖于人工智能。王凡也说道:“人类复杂的情感、传承至今的道德文化等是无法通过数据、公式计算得到的,ChatGPT或许会给司法领域带来一定的便利,但是在使用时还是要坚持德与法的兼顾,让法律和道德相辅相成、相得益彰。”“司法在某种意义上是处理人与人之间关系的工作,冰冷的ChatGPT显然无法理解人与人之间的情感与互动,无法应对复杂的法律推理与逻辑推演。”曹阳认为,ChatGPT虽然非常强大且具有潜在的广泛用途,但我们不应依赖于其进行复杂的推理或获取重要信息。“最好的写作者既不是ChatGPT,也不是人类,而是能够熟练和有洞察力地使用ChatGPT的人类。ChatGPT不应作为人类输入的替代品,不是独立的信息生产者与传播者,而是人类的辅助工具。”见习记者 | 张旭凡编辑 | 王菁 举报/反馈